Di tengah perkembangan dunia teknologi informasi, Diagram Alir Data (DFD) tetap menjadi artefak dasar untuk analisis sistem. Meskipun awalnya dikembangkan pada era pemrograman terstruktur tahun 1970-an, manfaat dari visualisasi bagaimana data bergerak melalui suatu sistem tidak berkurang. Justru telah berubah bentuk. Seiring organisasi menghadapi model pembelajaran mesin, sistem penyimpanan terdistribusi, dan aliran pemrosesan real-time, kebutuhan untuk memetakan lintasan data menjadi lebih kritis dari sebelumnya.

Panduan ini mengeksplorasi penyesuaian DFD terhadap lingkungan komputasi modern. Ia meninjau bagaimana diagram tradisional harus berkembang untuk merepresentasikan alur kerja kecerdasan buatan, arsitektur big data, dan infrastruktur berbasis cloud tanpa bergantung pada alat vendor tertentu. Fokus tetap pada integritas konseptual pergerakan data, keamanan, dan transformasi.

🏛️ Dasar: Memahami Diagram Alir Data

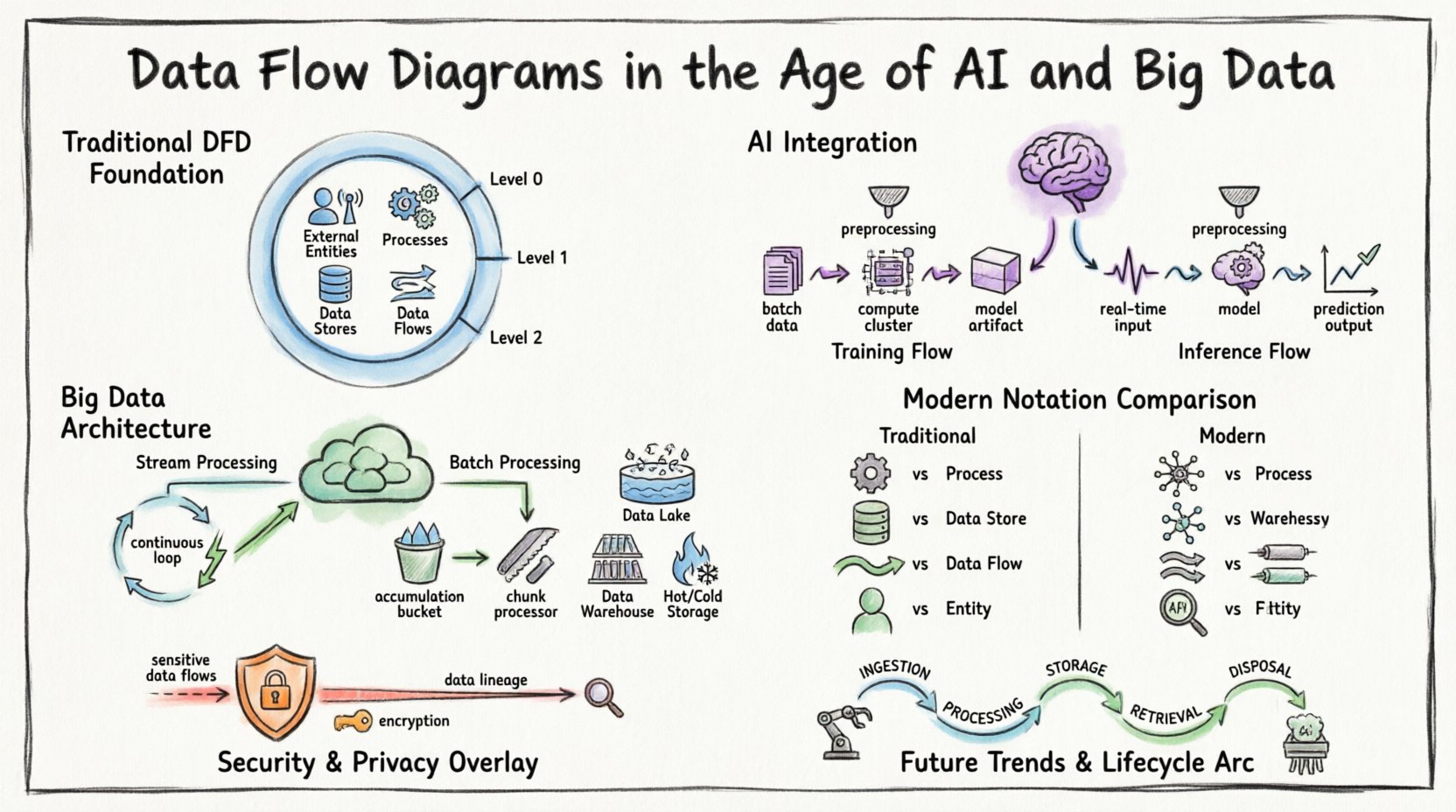

Sebelum menghadapi kompleksitas modern, penting untuk menetapkan definisi dasar. Diagram Alir Data adalah representasi grafis dari aliran data melalui suatu sistem informasi. Diagram ini memodelkan pergerakan informasi dari sumber eksternal ke tujuan dan proses internal.

Komponen kunci mendefinisikan DFD standar:

- Entitas Eksternal:Sumber atau tujuan di luar batas sistem (misalnya, pengguna, sistem lain, sensor).

- Proses:Transformasi yang mengubah data masukan menjadi data keluaran.

- Penyimpanan Data:Penyimpanan tempat data disimpan untuk digunakan nanti (misalnya, basis data, sistem file).

- Aliran Data:Pergerakan data antara entitas, proses, dan penyimpanan.

Dalam konteks tradisional, diagram ini sering digambar pada berbagai tingkat abstraksi:

- Diagram Konteks (Tingkat 0):Menunjukkan sistem sebagai satu proses tunggal dan interaksinya dengan entitas eksternal.

- Diagram Tingkat 1:Mendekomposisi proses utama menjadi sub-proses utama.

- Diagram Tingkat 2:Mendekomposisi lebih lanjut sub-proses tertentu untuk mendapatkan detail yang lebih rinci.

Meskipun hierarki ini tetap valid, sifat dari ‘proses’ telah berubah. Suatu proses tidak lagi hanya pekerjaan batch; sering kali merupakan layanan berkelanjutan atau model prediktif.

🧠 Integrasi AI: Memodelkan Kecerdasan dalam Aliran

Integrasi Kecerdasan Buatan (AI) memperkenalkan variabel baru dalam pemetaan aliran data. Dalam sistem tradisional, logika bersifat eksplisit. Dalam sistem yang didorong AI, logika sering bersifat probabilitas. Perbedaan ini mengharuskan pergeseran dalam cara kita memvisualisasikan komponen ‘Proses’ dalam DFD.

1. Aliran Pelatihan vs. Aliran Inferensi

Pipeline pembelajaran mesin berbeda secara signifikan dari logika aplikasi standar. DFD untuk sistem AI harus membedakan antara fase pelatihan dan fase inferensi.

- Aliran Pelatihan:Melibatkan dataset besar yang bergerak dari penyimpanan ke klaster komputasi. Outputnya adalah artefak model yang telah dilatih. Aliran ini sering bersifat batch dan intensif sumber daya.

- Aliran Inferensi:Melibatkan data real-time atau hampir real-time yang masuk ke dalam model untuk menghasilkan prediksi. Aliran ini mengutamakan latensi rendah dan throughput tinggi.

Saat memetakan aliran-aliran ini, sangat penting untuk dicatat bahwa model itu sendiri berperan sebagai proses kotak hitam. Logika internalnya tersembunyi, tetapi persyaratan input dan format output harus didefinisikan dengan jelas dalam diagram.

2. Pra-pemrosesan Data sebagai Suatu Proses

Sebelum data mencapai model AI, mengalami transformasi signifikan. Rekayasa fitur, normalisasi, dan pembersihan adalah langkah-langkah krusial yang harus terlihat dalam DFD. Mengabaikan langkah-langkah ini mengarah pada pemahaman sistem yang tidak lengkap.

- Normalisasi:Mengskala data agar sesuai dengan harapan model.

- Encoding:Mengonversi data kategorikal menjadi vektor numerik.

- Imputasi:Menangani nilai yang hilang dalam aliran.

Langkah-langkah pra-pemrosesan ini adalah proses. Mereka menghabiskan waktu dan sumber daya komputasi, serta menimbulkan titik-titik potensial kegagalan yang harus dilacak dalam aliran data.

🌊 Big Data: Menangani Volume, Kecepatan, dan Keragaman

Arsitektur big data menantang sifat linier dari DFD tradisional. Data sering datang dalam aliran, berada di danau data, dan diproses melalui komputasi terdistribusi. Diagram statis tidak dapat dengan mudah menangkap sifat dinamis dari lingkungan-lingkungan ini.

1. Pemrosesan Streaming vs. Batch

Sistem modern sering menggunakan pendekatan hibrida. Beberapa data diproses dalam aliran waktu nyata, sementara data lainnya diakumulasi untuk analisis batch. DFD harus dengan jelas membedakan dua jalur ini.

- Pemrosesan Aliran:Data mengalir terus-menerus. Diagram harus menggambarkan pipa sebagai lingkaran terus-menerus, bukan urutan mulai dan berhenti.

- Pemrosesan Batch:Data terakumulasi seiring waktu dan diproses dalam bagian-bagian. Diagram harus mencerminkan titik akumulasi (Penyimpanan Data) sebelum proses dimulai.

2. Visualisasi Penyimpanan Terdistribusi

Dalam basis data monolitik, penyimpanan data adalah satu kotak. Dalam lingkungan big data, penyimpanan terdistribusi. DFD harus menunjukkan bahwa ‘Penyimpanan Data’ sebenarnya dapat mewakili kumpulan node atau sistem penyimpanan yang dibagi.

- Danau Data:Penyimpanan data mentah di mana struktur diterapkan kemudian.

- Gudang Data:Penyimpanan terstruktur yang dioptimalkan untuk pencarian.

- Penyimpanan Panas vs. Dingin:Membedakan antara data yang sering diakses dan data arsip.

Perbedaan ini sangat penting untuk memahami latensi. Aliran dari node penyimpanan panas akan berperilaku berbeda dibandingkan aliran dari arsip penyimpanan dingin.

📐 Memperbarui Notasi

Untuk secara efektif menyampaikan sistem-sistem kompleks, notasi yang digunakan dalam DFD harus beradaptasi. Meskipun simbol inti tetap serupa, penerapannya membutuhkan nuansa.

| Komponen | DFD Tradisional | DFD Modern AI/Big Data |

|---|---|---|

| Proses | Langkah transformasi tunggal | Microservice, Inferensi Model, atau Tahap Pipeline |

| Penyimpanan Data | File atau Tabel Basis Data | Data Lake, Cache Terdistribusi, atau Penyimpanan Objek |

| Aliran Data | Permintaan/Tanggapan atau Transfer File | Aliran Acara, Isi API, atau Antrian Pesan |

| Entitas | Pengguna Manusia atau Sistem Warisan | Perangkat IoT, API Pihak Ketiga, atau Agen Otonom |

1. Arsitektur Berbasis Acara

Banyak sistem modern bergantung pada acara daripada permintaan langsung. DFD untuk sistem berbasis acara menggunakan pemicu untuk memulai proses. Alih-alih proses menunggu data, kedatangan data memicu proses.

- Antrian Pesan: Berfungsi sebagai buffer antara produsen dan konsumen.

- Catatan Acara: Catatan yang tidak dapat diubah dari perubahan status yang berfungsi sebagai penyimpanan data untuk audit.

Memvisualisasikan antrian ini sebagai penyimpanan data membantu menjelaskan masalah backpressure. Jika suatu proses tidak dapat mengikuti aliran masuk, antrian akan bertambah besar. Risiko ini harus dipetakan.

2. Microservice dan Batas

Ketika sistem terpecah menjadi microservice, batas sistem dalam DFD menjadi lebih tembus. Aliran data sering kali melintasi batas layanan melalui API. Penting untuk menandai protokol yang digunakan (misalnya, REST, gRPC, GraphQL) pada garis aliran data untuk menunjukkan persyaratan kompatibilitas.

- Penemuan Layanan:Pengalihan dinamis aliran data.

- Keseimbangan Beban:Distribusi aliran data di seluruh beberapa instance.

🔒 Keamanan dan Privasi dalam Aliran Data

Keamanan tidak boleh menjadi pertimbangan terakhir dalam diagram aliran data. Dengan regulasi seperti GDPR dan CCPA, memahami di mana data sensitif berada dan bergerak adalah wajib.

1. Mengidentifikasi Data Sensitif

Aliran data yang membawa Informasi Pribadi yang Dapat Diidentifikasi (PII) atau Informasi Kesehatan yang Dilindungi (PHI) harus ditandai. Gunakan gaya garis atau warna yang berbeda untuk menandai aliran yang sensitif.

- Enkripsi Saat Dalam Perjalanan: Semua aliran yang melintasi batas jaringan harus menunjukkan protokol enkripsi (misalnya, TLS).

- Enkripsi Saat Tertahan: Penyimpanan data yang berisi data sensitif harus ditandai.

2. Asal Data

Memahami asal data sangat penting untuk kepatuhan. DFD berfungsi sebagai peta asal data tingkat tinggi. Menunjukkan di mana data memasuki sistem dan bagaimana data tersebut berubah.

- Pelacakan Persetujuan: Aliran yang melibatkan data persetujuan pengguna harus dilacak secara terpisah.

- Hak untuk Dihapus: Diagram harus menunjukkan di mana data disimpan untuk memudahkan permintaan penghapusan.

Jika DFD tidak menunjukkan di mana data disimpan, audit kepatuhan menjadi mustahil. Setiap penyimpanan data harus memiliki pemilik yang ditentukan dan kebijakan penyimpanan.

⚙️ Tantangan dalam Pembuatan DFD Modern

Membuat diagram yang akurat untuk sistem yang kompleks menimbulkan tantangan khusus. Volume data dan kecepatan perubahan sering kali melebihi upaya dokumentasi.

1. Sistem Dinamis

Kelompok auto-scaling mengubah jumlah instans proses secara dinamis. Diagram statis tidak dapat menunjukkan hal ini. Diagram harus merepresentasikan *kemampuan* sistem, bukan hanya keadaan saat ini.

- Gunakan label umum seperti ‘Cluster Komputasi’ daripada ID instans khusus.

- Tunjukkan pemicu peningkatan skala dalam deskripsi proses.

2. Pengelolaan Kompleksitas

Seiring sistem berkembang, DFD menjadi tidak terbaca. Abstraksi adalah kunci. Jangan peta setiap titik akhir API. Peta pergerakan data secara logis.

- Pengelompokan:Gabungkan proses yang terkait menjadi satu super-proses.

- Menghubungkan:Gunakan referensi silang untuk menghubungkan sub-diagram rinci ke gambaran umum tingkat tinggi.

3. Ketergantungan Real-Time

Dalam sistem streaming, urutan operasi sangat penting. DFD menunjukkan koneksi, tetapi tidak selalu menunjukkan waktu. Tambahkan diagram urutan jika waktu sangat krusial.

- Tunjukkan waktu habis dan ulang dalam deskripsi proses.

- Catat apakah aliran data bersifat sinkron atau asinkron.

🚀 Tren Masa Depan: Otomatisasi dan Dokumentasi Mandiri

Masa depan DFD terletak pada otomatisasi. Seiring sistem menjadi lebih berbasis kode, diagram harus dihasilkan dari kode dasar, bukan digambar secara manual.

1. Infrastruktur sebagai Kode (IaC)

Ketika infrastruktur didefinisikan dalam kode, aliran data didefinisikan secara implisit. Alat dapat menganalisis file IaC untuk menghasilkan DFD secara otomatis.

- Pastikan konsistensi antara diagram dan infrastruktur yang sebenarnya.

- Gunakan kontrol versi untuk definisi diagram itu sendiri.

2. Penemuan Berkelanjutan

Alat pemantauan jaringan dapat mendeteksi aliran data yang sebenarnya. Mengintegrasikan alat ini dengan perangkat lunak DFD memungkinkan diagram ‘hidup’ yang diperbarui seiring perubahan pola lalu lintas.

- Berikan peringatan ketika aliran data baru muncul yang tidak terdokumentasi.

- Tandai penyimpanan data yang tidak digunakan yang dapat dinonaktifkan.

3. Diagram yang Didukung Kecerdasan Buatan

Kecerdasan Buatan dapat menyarankan perbaikan pada diagram. Ia dapat mengidentifikasi hambatan, jalur yang berulang, atau celah keamanan berdasarkan praktik terbaik.

- Validasi otomatis aturan aliran data (misalnya, tidak ada aliran langsung dari basis data ke entitas eksternal tanpa proses).

- Saran mengenai dekomposisi proses yang optimal.

🛠️ Praktik Terbaik untuk Implementasi

Untuk mempertahankan nilai DFD dalam konteks modern, patuhi praktik berikut ini.

- Standarkan Notasi:Pastikan semua anggota tim menggunakan simbol dan konvensi yang sama. Konsistensi mengurangi beban kognitif.

- Tentukan Konvensi Penamaan:Proses harus diberi nama dengan struktur Kata Kerja-Kata Benda (misalnya, “Validasi Masukan Pengguna”). Penyimpanan data harus diberi nama sebagai Kata Benda (misalnya, “Profil Pengguna”).

- Ulas Secara Berkala:Diagram yang tidak diulas akan menjadi kebohongan. Jadwalkan ulasan selama perencanaan sprint atau pertemuan penyempurnaan arsitektur.

- Fokus pada Nilai:Hanya petakan aliran data yang diperlukan untuk logika bisnis. Hapus aliran internal yang berulang yang tidak memengaruhi pengguna akhir.

- Dokumentasikan Asumsi: Jika suatu aliran mengasumsikan latensi atau throughput tertentu, dokumentasikan hal tersebut. Asumsi ini memengaruhi desain sistem.

🔄 Siklus Hidup Aliran Data

Memahami siklus hidup membantu dalam memetakan diagram secara akurat. Data bergerak melalui beberapa tahap:

- Ingesti:Data memasuki batas sistem. Ini sering kali merupakan titik yang paling tidak stabil.

- Pemrosesan:Data diubah, diperkaya, atau dianalisis.

- Penyimpanan:Data disimpan untuk digunakan di masa depan.

- Pengambilan:Data diakses untuk pelaporan atau tindakan.

- Pembuangan:Data diarsipkan atau dihapus sesuai kebijakan.

Setiap tahap mewakili proses atau penyimpanan potensial dalam DFD. Diagram yang lengkap mempertimbangkan tahap pembuangan, memastikan data tidak tetap berlama-lama secara tidak perlu.

📊 Ringkasan Komponen Utama

Untuk referensi cepat, berikut adalah penjelasan bagaimana komponen tradisional dipetakan ke setara modernnya.

| Konsep Tradisional | Setara Modern | Pertimbangan |

|---|---|---|

| Input | Gateway API / Saluran Ingesti | Autentikasi dan Pembatasan Kecepatan |

| Output | Dasbor / Layanan Pemberitahuan | Format dan Saluran Pengiriman |

| Proses | Fungsi / Wadah / Model | Tanpa Status dan Skalabilitas |

| Penyimpanan | Penyimpanan Objek / Basis Data NoSQL | Pembagian dan Pengindeksan |

| Aliran | Pesan Acara / Permintaan HTTP | Latensi dan Keandalan |

Dengan menyelaraskan konsep-konsep ini, tim dapat membuat diagram yang berfungsi sebagai alat komunikasi yang efektif di antara tim rekayasa, ilmu data, dan pemangku kepentingan bisnis. Tujuannya bukan kesempurnaan, tetapi kejelasan. Diagram yang membantu dalam pengambilan keputusan dianggap sukses.

🔮 Pikiran Akhir tentang Visualisasi Aliran Data

Prinsip-prinsip Diagram Aliran Data bersifat abadi, tetapi penerapannya memerlukan penyesuaian. Seiring data menjadi aset utama perusahaan modern, kemampuan untuk memvisualisasikan pergerakannya menjadi keunggulan strategis. Baik mengelola basis data sederhana maupun pipeline jaringan saraf yang kompleks, DFD memberikan struktur yang diperlukan untuk memahami, mengamankan, dan mengoptimalkan aliran informasi.

Menjaga agar tetap up-to-date dengan metodologi ini memastikan bahwa arsitektur sistem tetap transparan dan dapat dipelihara. Perpindahan dari dokumentasi statis ke visualisasi dinamis dan otomatis adalah hal yang tak terhindarkan. Tim yang menerima perubahan ini akan menemukan diri mereka lebih siap menghadapi kompleksitas era digital.

Fokus pada data. Ikuti alirannya. Pastikan logikanya tetap konsisten. Ini tetap menjadi mandat utama desain sistem yang efektif.