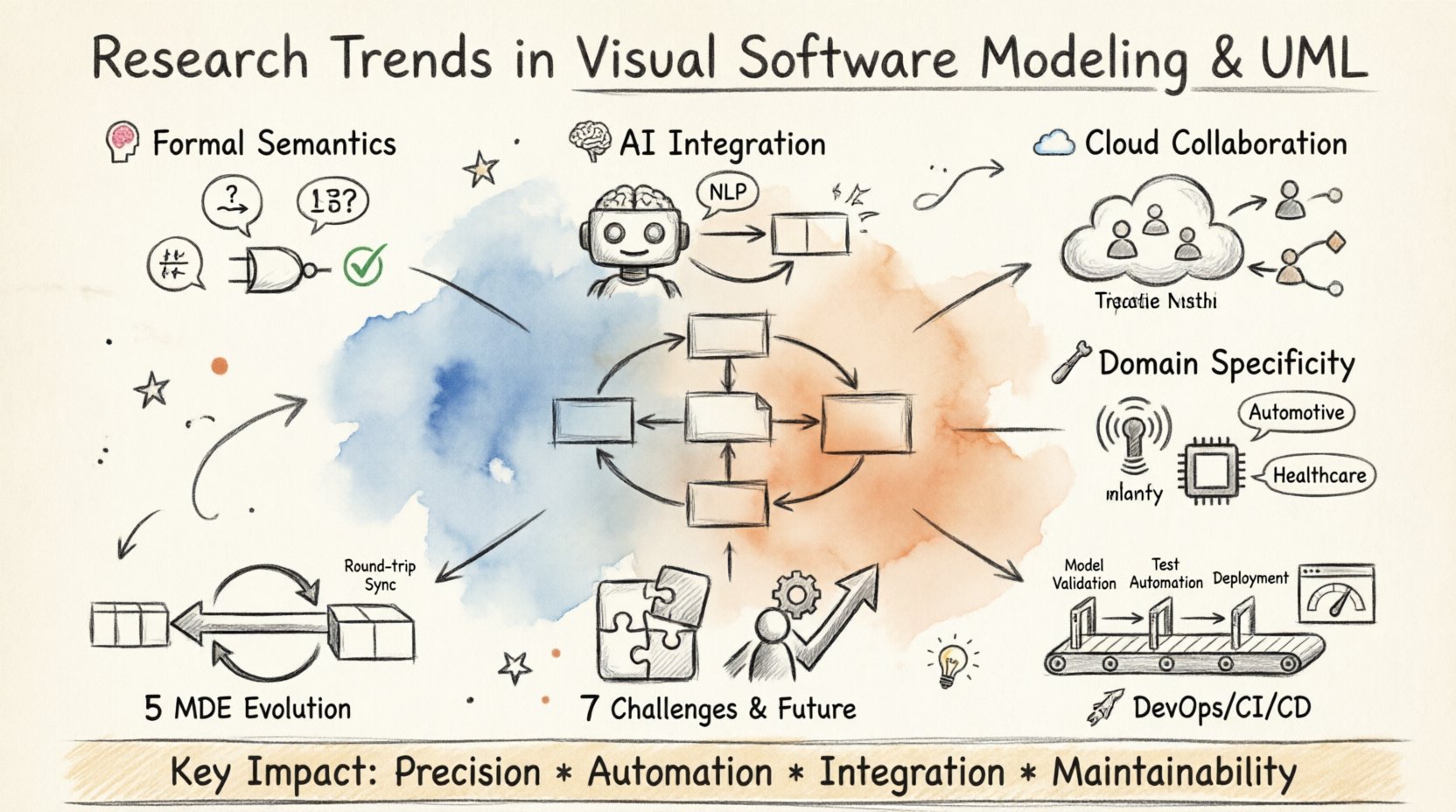

💡 Wichtige Erkenntnisse

- Formale Semantik:Moderne Modellierung stützt sich zunehmend auf mathematische Grundlagen, um Korrektheit und Verifizierung zu gewährleisten.

- Integration von KI:Maschinelles Lernmodell wird nun verwendet, um Diagramme automatisch zu generieren und zu validieren.

- Zusammenarbeit:Cloud-basierte Umgebungen erleichtern die Echtzeit-Zusammenarbeit bei der Gestaltung über verteilte Ingenieurteams hinweg.

- Domänen-Spezifität:Allgemeinverwendbare Notationen entwickeln sich weiter, um spezialisierte Branchenbereiche wie IoT und Automobil zu unterstützen.

Das Landschaft der Softwarearchitektur verändert sich weiterhin. Die visuelle Softwaremodellierung, insbesondere durch die Unified Modeling Language (UML), bleibt ein Eckpfeiler der Systemgestaltung. Die Werkzeuge und Methoden rund um diese Diagramme unterliegen jedoch einer erheblichen Transformation. Dieser Artikel untersucht die vorherrschenden Forschungstrends, die bestimmen, wie wir komplexe Systeme heute visualisieren und validieren.

Die Verschiebung von Syntax zu Semantik 🧠

Seit Jahrzehnten lag der Schwerpunkt der Modellierung auf der syntaktischen Korrektheit. Die Einhaltung der Grammatikregeln von UML in einem Klassendiagramm war die grundlegende Anforderung. Aktuelle Forschung legt jedoch Wert auf semantische Präzision. Das Ziel ist nicht nur, ein Kästchen und eine Pfeil zu zeichnen, sondern die genaue Bedeutung dieser Verbindung zu definieren.

Forscher untersuchen formale Methoden, die UML mit mathematischer Logik überlagern. Dieser Ansatz ermöglicht eine automatisierte Schlussfolgerung über das Modell selbst. Anstatt sich ausschließlich auf menschliche Prüfung zur Erkennung logischer Fehler zu verlassen, können Werkzeuge nun Eigenschaften wie Deadlock-Freiheit oder Erreichbarkeit von Zuständen direkt aus der visuellen Darstellung verifizieren.

Diese Verschiebung schließt eine kritische Lücke im traditionellen Ingenieurwesen: die Trennung zwischen dem Entwurfsdiagramm und dem ausführbaren Code. Durch die Verankerung visueller Elemente in der formalen Semantik verbessert sich die Treue zwischen Modell und Implementierung erheblich.

Entwicklung der modellgetriebenen Entwicklung (MDE) 🔄

Die modellgetriebene Entwicklung ist von einem theoretischen Konzept zu einer praktischen Arbeitsweise für viele Organisationen gereift. Die zentrale Grundlage bleibt: Modelle sind nicht nur Dokumentation; sie sind Artefakte, die die Codegenerierung antreiben. Neueste Fortschritte konzentrieren sich auf bidirektionale Transformation.

Traditionell floss die Codegenerierung von Modell zu Code. Wenn sich der Code änderte, wurde das Modell oft veraltet. Neue Forschung betont die Rundreisentechnik, bei der Änderungen in der Implementierung zurück zum Modell übertragen werden. Diese Synchronisation stellt sicher, dass die visuelle Darstellung während des gesamten Software-Lebenszyklus eine Quelle der Wahrheit bleibt.

Die Komplexität moderner Systeme erfordert mehr als nur einfache Boilerplate-Generierung. Die Forschung zielt nun auf domänenspezifische Codegenerierung ab, die sich an den architektonischen Stil des Projekts anpasst. Dies ermöglicht es Teams, hochwertige Abstraktionen beizubehalten, während dennoch optimierte, produktionsfertige Artefakte erzeugt werden.

Künstliche Intelligenz und automatisierte Modellierung 🤖

Die Integration von künstlicher Intelligenz in Modellierungswerkzeuge ist vielleicht der sichtbarste Trend. Natürliche Sprachverarbeitung (NLP) ermöglicht es Ingenieuren, Systemanforderungen in Textform zu beschreiben, die dann in Diagramme umgewandelt werden. Dies senkt die Einstiegshürde für komplexe Modellierungsaufgaben.

Über die Generierung hinaus wird KI zur Verbesserung von Modellen eingesetzt. Algorithmen analysieren bestehende Diagramme, um Optimierungen vorzuschlagen, Redundanzen zu identifizieren oder Designmuster zu erkennen, die übersehen wurden. Dies fungiert als intelligente Überprüfungsmechanismus und liefert Feedback, das menschliche Expertise ergänzt.

Darüber hinaus werden prädiktive Analysen eingesetzt, um die Qualität eines Entwurfs vor Beginn der Implementierung zu bewerten. Durch die Schulung von Modellen an historischen Projekt-Daten können Systeme potenzielle Wartungskosten oder Ausfallstellen basierend allein auf der Struktur des Diagramms vorhersagen.

Kooperative und cloudbasierte Umgebungen ☁️

Die Softwareentwicklung wird zunehmend verteilt. Remote-Arbeit und globale Teams erfordern einen Wechsel von lokaldateibasierten Modellierungen hin zu kooperativen Cloud-Plattformen. Dies ermöglicht es mehreren Stakeholdern, Modelle gleichzeitig zu bearbeiten und anzuzeigen.

Die Forschung in diesem Bereich konzentriert sich auf Konfliktlösung und Versionskontrolle für visuelle Daten. Im Gegensatz zu Textcode können visuelle Elemente auf komplexe Weise überlappen. Neue Algorithmen verwalten gleichzeitige Bearbeitungen, um sicherzustellen, dass Änderungen von verschiedenen Benutzern korrekt zusammengeführt werden, ohne Daten zu verlieren.

Die Cloud-Integration erleichtert zudem eine bessere Kommunikation mit Stakeholdern. Nicht-technische Teammitglieder können vereinfachte Ansichten des Systems aufrufen, ohne spezialisierte Modellierungssoftware zu benötigen. Dies demokratisiert das Verständnis der Architektur und aligniert geschäftliche Ziele mit der technischen Umsetzung.

Domänen-spezifische Sprachen und hybride Ansätze 🛠️

Allgemeinverwendbare Modellierungssprachen stoßen bei der Anwendung auf hochspezialisierte Bereiche an ihre Grenzen. Ein Diagramm, das für Webanwendungen gut funktioniert, kann die Feinheiten sicherheitskritischer Automobilsysteme oder IoT-Netzwerke möglicherweise nicht erfassen.

Daher besteht ein starker Trend hin zu domain-spezifischem Modellieren (DSM). Forscher entwickeln Notationen, die auf bestimmte Branchen zugeschnitten sind. Diese DSLs erben die visuelle Klarheit von UML, enthalten aber Konzepte und Einschränkungen, die für ihren Bereich relevant sind.

Hybride Ansätze gewinnen ebenfalls an Bedeutung. Diese Frameworks ermöglichen es, ein allgemein verwendbares Modell durch domain-spezifische Annotationen zu erweitern. Dies bietet Flexibilität und ermöglicht es Teams, Standardnotationen zu verwenden, während sie spezialisierte Metadaten dort einbetten, wo nötig.

Integration mit DevOps und CI/CD 🚀

Der Abstand zwischen Design und Bereitstellung verengt sich. In modernen Pipelines sind Modelle keine statischen Artefakte, die am Anfang eines Projekts erstellt werden. Sie sind in die Arbeitsabläufe der kontinuierlichen Integration und kontinuierlichen Bereitstellung (CI/CD) integriert.

Das automatisierte Testen von Modellen wird zur Standardpraxis. Bevor der Code zusammengeführt wird, durchläuft das Modell Überprüfungen. Wenn das Modell definierte Einschränkungen verletzt, wird die Pipeline angehalten. Dies verlagert die Qualitätssicherung früher in den Prozess und reduziert die Kosten für die Behebung von Fehlern.

Visualisierungstools werden ebenfalls in Dashboards integriert. Ingenieure können die Auswirkungen einer Bereitstellung auf die Systemarchitektur in Echtzeit sehen. Diese Rückkopplungshaltung hilft Teams, die Folgen von Änderungen sofort zu verstehen, anstatt Wochen später.

Herausforderungen und zukünftige Entwicklungen 🌐

Trotz dieser Fortschritte bestehen weiterhin Herausforderungen. Die Komplexität von Modellen kann sich exponentiell erhöhen, wenn Systeme skaliert werden. Die Verwaltung dieser Komplexität ohne Überforderung des Benutzers ist ein zentrales Forschungsthema. Techniken wie Abstraktion, Kuratierung und dynamische Ansichtsgenerierung werden verfeinert, um große Architekturen zu bewältigen.

Die Interoperabilität zwischen verschiedenen Modellierungswerkzeugen ist eine weitere Hürde. Die Standards für den Datenaustausch verbessern sich, aber eine nahtlose Integration über die gesamte Toolkette hinweg ist weiterhin in Arbeit. Die Forschung setzt sich weiterhin dafür ein, Metadaten-Austauschformate zu standardisieren, um Portabilität zu gewährleisten.

Der menschliche Faktor bleibt zentral. Technologie kann die Intuition und Kreativität des Architekten nicht ersetzen. Ziel dieser Trends ist es, die menschlichen Fähigkeiten zu unterstützen, nicht zu ersetzen. Werkzeuge, die die kognitive Belastung verringern und kritische Risiken hervorheben, sind die wertvollsten Assets in diesem sich entwickelnden Umfeld.

Zusammenfassung der Auswirkungen 📈

Die Entwicklung des visuellen Softwaremodellierens bewegt sich in Richtung größerer Präzision, Automatisierung und Integration. Durch die Aufnahme formaler Semantik, die Nutzung von KI und die Einführung kooperativer Cloud-Umgebungen baut die Branche Systeme auf, die robuster und einfacher zu pflegen sind. Diese Trends spiegeln eine Reife in unserer Herangehensweise an die Softwarearchitektur wider, die sie als dynamisches, lebendiges Artefakt statt eines statischen Dokuments betrachtet.