人工知能(AI)と機械学習(ML)の時代において、組織は単にアプリケーションを開発するだけでなく、学習・適応し、リアルタイムのインサイトを提供できるインテリジェントなシステムを構築している。この変革の中心に位置するのはAIクラウドアーキテクチャ—スケーラビリティを備えたAI/MLワークロードの開発、トレーニング、デプロイ、管理を可能にする強力で目的に応じて設計されたフレームワークである。

この包括的なガイドは、AIクラウドアーキテクチャの本質、そのコアコンポーネント、戦略的活用事例、実装のベストプラクティス、重要なコンセプト、デプロイモデルについて探求し、企業がクラウド上のAIの全潜在能力を活用できるように支援する。

🔷 AIクラウドアーキテクチャとは何か?

AIクラウドアーキテクチャは、クラウドベースでスケーラブルなインフラストラクチャの構造設計であり、計算、ストレージ、ネットワーキングリソースを含み、人工知能(AI)および機械学習(ML)ワークロードをサポートするために特に最適化されている。このアーキテクチャは、AIモデルの構築、トレーニング、デプロイ、管理を効率的かつ安全に行うための基盤となる。

✅ 定義:それは、インフラストラクチャ、データ管理、オーケストレーションから構成されるフレームワークであり、AI/MLモデルをスケーラビリティをもって構築・トレーニング・デプロイ可能にする。

このアーキテクチャは、GPU(グラフィックス処理ユニット)やTPU(テンソル処理ユニット)など、専用のハードウェアを活用する。GPU(グラフィックス処理ユニット)およびTPU(テンソル処理ユニット)、堅牢なデータパイプラインを統合し、マイクロサービスとコンテナオーケストレーションを活用して、インテリジェントで応答性が高くスケーラブルなアプリケーションを提供する。

🧱 AIクラウドアーキテクチャのコアレイヤー

適切に設計されたAIクラウドアーキテクチャは、5つの基盤となるレイヤーで構成される。

| レイヤー | 説明 |

|---|---|

| 1. インフラストラクチャレイヤー | 高性能な計算(GPU/TPU)、スケーラブルなネットワーキング、耐障害性のあるストレージを提供する。大規模なモデルトレーニングの並列処理を可能にする。 |

| 2. データパイプラインレイヤー | 多様なソース(IoT、データベース、APIなど)からの高速度・大量のデータのインジェスト、前処理、変換、ストレージを管理する。 |

| 3. AI/MLモデルレイヤー | TensorFlow、PyTorch、scikit-learnなどのフレームワークを使って開発された、事前学習済みモデルおよびカスタムモデルを格納する。 |

| 4. オーケストレーションおよびMLOpsレイヤー | CI/CDパイプライン、バージョン管理、モニタリング、再トレーニングワークフローを通じて、モデルのライフサイクルを自動化する。Kubernetes、Argo、またはクラウドネイティブなMLOpsツールなどのプラットフォーム上で構築される。 |

| 5. アプリケーションおよびサービングレイヤー | API、ウェブサービス、モバイルアプリ、またはエッジデバイスを通じてAI機能を提供します。リアルタイム推論とバッチ予測をサポートしています。 |

これらのレイヤーは調和して働き、データから意思決定に至るスムーズなパイプラインを構築します。

⚙️ AIクラウドアーキテクチャの主要な構成要素

クラウド上のAIの全機能を実現するためには、いくつかの重要な構成要素を統合する必要があります:

-

Kubernetes (K8s):コンテナオーケストレーションの事実上の標準であり、AIマイクロサービスの動的スケーリングと管理を可能にします。

-

サーバーレスコンピューティング:AI推論ワークロードに最適で、自動スケーリングと使用量課金が可能(例:AWS Lambda、Azure Functions)。

-

高性能ストレージ:トレーニングデータセットへの高速アクセスを可能にする、SSD搭載ブロックストレージおよびオブジェクトストレージ(例:S3、Cloud Storage)。

-

データレイクおよびデータウェアハウス:構造化データと非構造化データをそのまま保存する、中央集積型のリポジトリ(例:Amazon S3、Snowflake、Delta Lake)。

-

モデルサービングプラットフォーム:低遅延推論用に、TensorFlow Serving、TorchServe、またはクラウド管理型ソリューション(例:SageMakerエンドポイント)などのツール。

-

モニタリングおよび可視性:モデルのパフォーマンス、ドリフト検出、遅延、システムの健全性をリアルタイムで追跡。

これらの構成要素は、AIライフサイクル全体にわたり、耐障害性、スケーラビリティ、運用効率を確保します。

📌 AIクラウドアーキテクチャを使用するタイミング

AIクラウドアーキテクチャは万能のソリューションではありませんが、特定の状況下では不可欠になります:

✅ 高負荷ワークロード

組織が以下の作業を実行する場合:リソース集約型のAIトレーニングジョブ—例として大規模言語モデル(LLM)、コンピュータビジョンシステム、強化学習エージェントなど—、テラバイト単位のデータと数百万のパラメータを処理できるスケーラブルなGPU/TPUクラスタが必要です。

💡 例:1000億パラメータのLLMをトレーニングするには、数百台のGPUと分散処理が必要であり、クラウド規模のインフラストラクチャがなければ実現できません。

✅ リアルタイムインテリジェンス

以下の要件を満たすアプリケーションの場合:即時応答、例えば不正検出、自動運転車、リアルタイムレコメンデーションエンジンなど、AIをエッジやクラウドに展開する必要があります。エッジは不可欠です。

🌐 エッジAI: 推論をデータソース(例:IoTセンサー、スマートフォン)に近づけることで、遅延と帯域幅の使用量が削減されます。

✅ ハイブリッド/マルチクラウドの柔軟性

厳格な規制要件やレガシーシステムを持つ企業は、ハイブリッドまたはマルチクラウド戦略により、AIワークロードをオンプレミスのデータセンター、パブリッククラウド(AWS、Azure、GCP)、およびプライベートクラウドの間で柔軟に移動でき、コンプライアンスとデータ主権を維持しながら運用できます。

🔐 ユースケース:医療機関がオンプレミスでモデルを学習(HIPAA準拠のため)するが、スケーラビリティを目的として推論をパブリッククラウドに展開する。

🛠️ AIクラウドアーキテクチャの構築と実装方法

AIクラウドアーキテクチャを実装するには、構造的で段階的なアプローチが必要です。以下の5つのステップに従ってください:

1. セキュアなデータ基盤を構築する

-

構築する データレイク または データウェアハウス ストリーミングデータおよびバッチデータを受信できるもの。

-

データガバナンス、ラインレージ追跡、アクセス制御を実装する。

-

リアルタイムデータのインジェストには、Apache Kafka、AWS Glue、またはGoogle Dataflowなどのツールを使用する。

2. 適切なクラウドインフラを選択する

AI向けに最適化されたクラウドプロバイダーおよびサービスを選択する:

-

AWS: SageMaker、EC2 GPUインスタンス(P4、G5)、S3

-

Azure: Azure ML、GPU VM、Blobストレージ、Databricks

-

GCP: Vertex AI、TPUポッド、BigQuery、Cloud Storage

🎯 ヒント: 次を選択してください GPU/TPU最適化インスタンス トレーニング中に;次に切り替える スポットインスタンス または サーバーレス 推論時のコスト削減のために。

3. MLOpsの実践を導入する

AIライフサイクル全体を自動化する:

-

データ、コード、モデルのバージョン管理(DVC、MLflow、またはGitを使用)。

-

モデルの再トレーニングおよびデプロイメント用のCI/CDパイプライン。

-

性能の低下、データドリフト、バイアスに対するモデルモニタリング。

🔄 MLOps = AIのDevOps — 再現性、信頼性、トレーサビリティを確保します。

4. パフォーマンスとコストの最適化

-

次を使用してください オートスケーリンググループ 需要に応じて計算リソースを調整する。

-

次を活用する スポットインスタンス および プリエンプティブルVM 非重要なトレーニングジョブに使用する。

-

使用するデータ圧縮, キャッシュ、および階層ストレージコスト削減に役立つ。

5. ガバナンスと倫理的なAIを統合する

最初からセキュリティとコンプライアンスを統合する:

-

静止中および転送中のデータを暗号化する。

-

ロールベースアクセス制御(RBAC)を実装する。

-

モデルのバイアス、公平性、説明可能性(XAI)を監視する。

-

GDPR、CCPA、HIPAAなどの規制への準拠を確保する。

🛡️ 予防的なガバナンスにより、高コストの失敗や評判損傷を防ぐ。

🔑 AIクラウドアーキテクチャの主要なコンセプト

これらの基盤となるコンセプトを理解することは、効果的なAIシステムを設計する上で不可欠である:

| コンセプト | 説明 |

|---|---|

| MLOps(機械学習運用) | ML、DevOps、データエンジニアリングを統合し、モデルライフサイクルを自動化・最適化する分野。 |

| データ重力 | 大規模なデータセットをネットワークを越えて移動するという課題。解決策:データに近い場所に計算リソースを配置する(例:オンプレミスまたは地域クラウドゾーン)。 |

| モデルサービング/推論 | 訓練済みモデルをデプロイして予測を行うプロセス。リアルタイム(API)またはバッチ(スケジュールされたジョブ)のどちらでも可能。 |

| エッジAI | AIモデルをエッジデバイス(カメラ、センサー、スマートフォンなど)上で直接実行し、遅延と帯域幅を削減する。 |

| スケーラビリティとコスト最適化 | 自動スケーリング、スポットインスタンス、効率的なストレージを活用して、変動するワークロードを管理し、クラウドコストを削減する。 |

これらの原則は、耐障害性があり、効率的で、将来にわたって対応可能な設計へとアーキテクトを導きます。

🌐 一般的な展開モデル

あなたのビジネスニーズに基づいて、適切な展開モデルを選択してください:

| モデル | 長所 | 短所 | 最適な用途 |

|---|---|---|---|

| パブリッククラウド | 迅速なプロビジョニング、無限のスケーラビリティ、豊富なAIサービス(SageMaker、Vertex AI) | データ主権に関する懸念が生じる可能性 | スタートアップ、イノベーションチーム、スケーラブルなAIアプリ |

| プライベートクラウド | 完全なコントロール、強化されたセキュリティ、コンプライアンス | 高い設置コスト、スケーラビリティの限界 | 金融機関、政府機関 |

| ハイブリッドクラウド | セキュリティと柔軟性のバランスを取る;オンプレミスとクラウド間でワークロードを移動可能 | 複雑な統合 | レガシーシステムを有する企業および厳格なコンプライアンス要件を満たす企業 |

| マルチクラウド | ベンダーの縛りを回避し、最適なサービス選択を可能にする | 管理の複雑さが増す | 冗長性とコスト効率を求める大手企業 |

🔄 トレンド: 大多数の企業が採用している ハイブリッド/マルチクラウド アジャイル性、セキュリティ、コストのバランスを取る戦略。

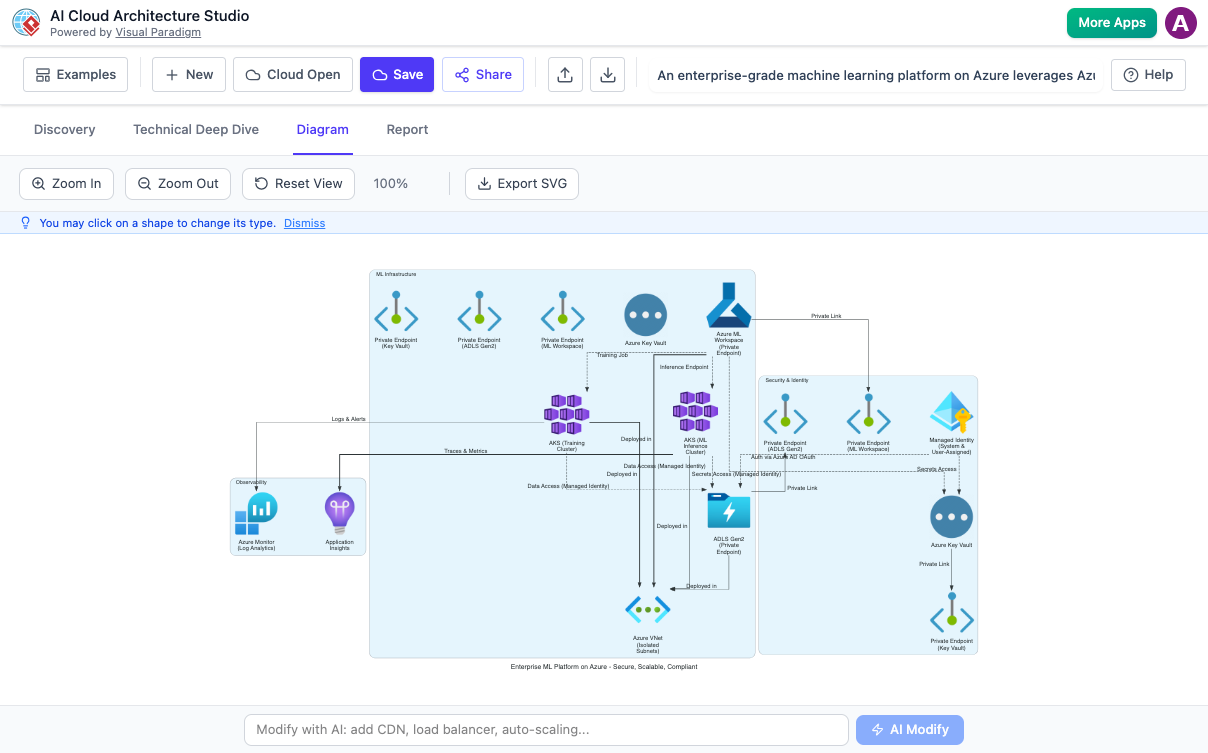

🛠️ Visual ParadigmのAIクラウドアーキテクチャスタジオ:画期的な変化

AIシステムの複雑さが増す中で、視覚的モデリングは不可欠になります。ここに登場するのが Visual ParadigmのAIクラウドアーキテクチャスタジオ—AI駆動のクラウドアーキテクチャ設計を簡素化・加速するために設計された先進的なツール。

🌟 機能と対応能力:

-

AI駆動のモデリング:自然言語のプロンプトからアーキテクチャ図を生成する。

-

マルチクラウド対応:AWS、Azure、GCP、およびハイブリッド環境向けの設計を可能にする。

-

統合されたMLOpsワークフロー:CI/CDパイプライン、モデルバージョン管理、モニタリングを可視化する。

-

リアルタイム共同作業:チームはリアルタイムでアーキテクチャを共同設計・注釈可能。

-

自動文書化:技術文書、コンプライアンスレポート、デプロイメント計画を自動生成する。

📚 リソース:

- AIクラウドアーキテクチャスタジオ – Visual Paradigm:Visual ParadigmのAIクラウドアーキテクチャスタジオの公式機能概要。機能、マルチクラウド対応、AI駆動のワークフローとの統合を詳細に説明。

- クラウド設計の革新:Visual ParadigmのAIクラウドアーキテクチャスタジオの詳細分析:このツールのAI機能、ワークフロー、企業向けクラウドアーキテクチャにおける実際の応用を包括的に分析。

- AIクラウドアーキテクチャスタジオ発表のお知らせ:Visual Paradigmの公式リリースノート。2026年2月にツールがリリースされることを発表し、主な機能と初期の利用可能状況を含む。

- AIクラウドアーキテクチャスタジオ – Visual Paradigm AIポータル:AIクラウドアーキテクチャスタジオにアクセスするための専用Webポータル。ライブデモ、チュートリアル、ユーザーガイドを備える。

- AIクラウドアーキテクチャスタジオ – Visual ParadigmによるAIツールボックス:AI駆動のモデリングツールの中心的なハブ。クラウドアーキテクチャスタジオおよび関連するAI機能へのアクセスを含む。