In der Ära der künstlichen Intelligenz (KI) und des maschinellen Lernens (ML) bauen Organisationen nicht mehr nur Anwendungen, sondern intelligente Systeme, die lernen, sich anpassen und Echtzeit-Erkenntnisse liefern können. Im Zentrum dieser Transformation stehtKI-Cloud-Architektur—ein leistungsstarkes, maßgeschneidertes Framework, das die Entwicklung, das Training, die Bereitstellung und die Verwaltung von KI/ML-Arbeitslasten im großen Maßstab ermöglicht.

Dieser umfassende Leitfaden untersucht das Wesen der KI-Cloud-Architektur, ihre zentralen Komponenten, strategische Einsatzszenarien, Implementierungsbest Practices, zentrale Konzepte und Bereitstellungsmodelle – und befähigt Unternehmen, das volle Potenzial der KI in der Cloud zu nutzen.

🔷 Was ist KI-Cloud-Architektur?

KI-Cloud-Architekturist die strukturelle Gestaltung einer cloudbasierten, skalierbaren Infrastruktur – bestehend aus Rechen-, Speicher- und Netzwerkressourcen – die speziell darauf ausgelegt ist, KI- und ML-Arbeitslasten zu unterstützen. Sie dient als Rückgrat für die effiziente und sichere Entwicklung, das Training, die Bereitstellung und die Verwaltung von KI-Modellen.

✅ Definition:Es ist das Framework – bestehend aus Infrastruktur, Datenverwaltung und Orchestrierung –, das die Entwicklung, das Training und die Bereitstellung von KI/ML-Modellen im großen Maßstab ermöglicht.

Diese Architektur nutzt spezialisierte Hardware wieGPUs (Grafikverarbeitungseinheiten)undTPUs (Tensor-Verarbeitungseinheiten), integriert robuste Datenpipelines und setzt Mikroservices sowie Container-Orchestrierung ein, um intelligente, reaktionsfähige und skalierbare Anwendungen zu liefern.

🧱 Kernschichten der KI-Cloud-Architektur

Eine gut gestaltete KI-Cloud-Architektur besteht aus fünf grundlegenden Schichten:

| Schicht | Beschreibung |

|---|---|

| 1. Infrastrukturschicht | Bietet Hochleistungsrechenleistung (GPUs/TPUs), skalierbares Networking und widerstandsfähigen Speicher. Ermöglicht parallele Verarbeitung für das Training von Modellen im großen Maßstab. |

| 2. Datenpiped-Schicht | Verwaltet die Aufnahme, Vorverarbeitung, Transformation und Speicherung von hochgeschwindigen, hochvolumigen Daten aus unterschiedlichen Quellen (IoT, Datenbanken, APIs). |

| 3. KI/ML-Modellschicht | Beherbergt die maschinellen Lernmodelle – sowohl vortrainierte als auch maßgeschneiderte –, die mit Frameworks wie TensorFlow, PyTorch oder scikit-learn entwickelt wurden. |

| 4. Orchestrierungs- und MLOps-Schicht | Automatisiert den Lebenszyklus von Modellen über CI/CD-Pipelines, Versionsverwaltung, Überwachung und Workflows zum erneuten Training. Aufgebaut auf Plattformen wie Kubernetes, Argo oder cloud-nativen MLOps-Tools. |

| 5. Anwendungs- und Bereitstellungsschicht | Bietet KI-Funktionen über APIs, Webservices, Mobile Apps oder Edge-Geräte an. Unterstützt Echtzeit-Inferenz und Batch-Vorhersagen. |

Diese Schichten arbeiten harmonisch zusammen, um eine nahtlose Pipeline von Daten bis zur Entscheidungsfindung zu schaffen.

⚙️ Schlüsselkomponenten der KI-Cloud-Architektur

Um das volle Potenzial der KI in der Cloud zu realisieren, müssen mehrere kritische Komponenten integriert werden:

-

Kubernetes (K8s): Der de-facto-Standard für Container-Orchestrierung, der dynamisches Skalieren und die Verwaltung von KI-Mikrodiensten ermöglicht.

-

Serverless Computing: Ideal für KI-Inferenz-Arbeitslasten, die automatische Skalierung und Nutzungsgebühren ermöglichen (z. B. AWS Lambda, Azure Functions).

-

Hochleistungs-Speicher: SSD-basierter Block-Speicher und Objektspeicher (z. B. S3, Cloud Storage) für schnellen Zugriff auf Trainingsdatensätze.

-

Data Lakes & Data-Warehouses: Zentrale Repositories (z. B. Amazon S3, Snowflake, Delta Lake), die strukturierte und unstrukturierte Daten in ihrer Rohform speichern.

-

Plattformen zur Modellbereitstellung: Werkzeuge wie TensorFlow Serving, TorchServe oder cloud-basierte Lösungen (z. B. SageMaker Endpoints) für eine latenzarme Inferenz.

-

Monitoring & Beobachtbarkeit: Echtzeit-Verfolgung der Modellleistung, Detektion von Verschiebungen, Latenz und Systemzustand.

Diese Komponenten gewährleisten Resilienz, Skalierbarkeit und betriebliche Effizienz über den gesamten KI-Lebenszyklus hinweg.

📌 Wann die KI-Cloud-Architektur eingesetzt werden sollte

Die KI-Cloud-Architektur ist keine All-in-One-Lösung – wird aber unter bestimmten Bedingungen unverzichtbar:

✅ Hochleistungs-Arbeitslasten

Wenn Ihre Organisationressourcenintensive KI-Trainingsarbeiten—wie große Sprachmodelle (LLMs), Computer-Vision-Systeme oder Verstärkungslernagenten—benötigen Sie skalierbare GPU-/TPU-Cluster, die Terabytes an Daten und Millionen von Parametern verarbeiten können.

💡 Beispiel:Das Training eines LLM mit 100 Milliarden Parametern erfordert Hunderte von GPUs und verteiltes Rechnen – nur mit einer Cloud-Skala-Infrastruktur möglich.

✅ Echtzeit-Intelligenz

Für Anwendungen, diesofortige Antworten, wie Betrugserkennung, autonome Fahrzeuge oder Echtzeit-Empfehlungssysteme, ist die Bereitstellung von KI amKanteist entscheidend.

🌐 Edge-KI: Durch die Nähe der Inferenz zu den Datenquellen (z. B. IoT-Sensoren, Smartphones) wird die Latenz und der Bandbreitenverbrauch reduziert.

✅ Flexibilität bei Hybrid-/Multi-Cloud

Unternehmen mit strengen regulatorischen Anforderungen oder veralteten Systemen profitieren vonhybriden oder Multi-Cloud-Strategien, bei denen KI-Arbeitslasten flexibel zwischen lokalen Rechenzentren, öffentlichen Clouds (AWS, Azure, GCP) und privaten Clouds verschoben werden können – unter Wahrung der Compliance und der Datenhoheit.

🔐 Anwendungsfall:Ein Gesundheitsanbieter trainiert Modelle vor Ort (zur Einhaltung der HIPAA-Vorgaben), stellt jedoch die Inferenz in der öffentlichen Cloud zur Skalierbarkeit bereit.

🛠️ So bauen und implementieren Sie eine KI-Cloud-Architektur

Die Implementierung einer KI-Cloud-Architektur erfordert einen strukturierten, schrittweisen Ansatz. Befolgen Sie diese fünf Schritte:

1. Schaffen Sie eine sichere Datenbasis

-

Bauen SieDatenlakesoderDatenwarenhäuserdie in der Lage sind, Streaming- und Batch-Daten zu verarbeiten.

-

Implementieren Sie Daten-Governance, Linienverfolgung und Zugriffssteuerungen.

-

Verwenden Sie Tools wie Apache Kafka, AWS Glue oder Google Dataflow für die Echtzeit-Datenbeschaffung.

2. Wählen Sie die richtige Cloud-Infrastruktur

Wählen Sie Cloud-Anbieter und -Dienste, die speziell für KI entwickelt wurden:

-

AWS: SageMaker, EC2 GPU-Instanzen (P4, G5), S3

-

Azure: Azure ML, GPU-VMs, Blob-Speicher, Databricks

-

GCP: Vertex AI, TPU-Pods, BigQuery, Cloud Storage

🎯 Tipp: Wählen Sie GPU/TPU-optimierte Instanzen während des Trainings; wechseln Sie zu Spot-Instanzen oder serverlos zur Kosteneinsparung während der Inferenz.

3. Implementieren Sie MLOps-Praktiken

Automatisieren Sie den gesamten KI-Lebenszyklus:

-

Versionskontrolle für Daten, Code und Modelle (verwenden Sie DVC, MLflow oder Git).

-

CI/CD-Pipelines für das erneute Training und die Bereitstellung von Modellen.

-

Modellüberwachung zur Erkennung von Leistungsabfall, Datenabweichung und Verzerrung.

🔄 MLOps = DevOps für KI — Stellt Wiederholbarkeit, Zuverlässigkeit und Nachvollziehbarkeit sicher.

4. Optimieren Sie für Leistung und Kosten

-

Verwenden Sie Auto-Scaling-Gruppen um die Rechenleistung an die Nachfrage anzupassen.

-

Nutzen Sie Spot-Instanzen und verdrängbare VMs für nicht-kritische Trainingsaufgaben.

-

Einsetzen Datenkompression, Caching, und gestaffelte Speicherung um Kosten zu senken.

5. Governance und ethisches KI in die Architektur integrieren

Integrieren Sie Sicherheit und Compliance von Tag eins an:

-

Daten ruhend und im Transport verschlüsseln.

-

Rollenbasierten Zugriffskontrollmechanismus (RBAC) implementieren.

-

Auf Modellverzerrung, Fairness und Erklärbarkeit (XAI) überwachen.

-

Sicherstellen der Einhaltung von Vorschriften wie DSGVO, CCPA, HIPAA.

🛡️ Proaktive Governance verhindert kostspielige Ausfälle und reputationsgefährdende Schäden.

🔑 Schlüsselkonzepte der KI-Cloud-Architektur

Das Verständnis dieser grundlegenden Konzepte ist entscheidend für die Gestaltung effektiver KI-Systeme:

| Konzept | Erklärung |

|---|---|

| MLOps (Maschinelles Lernen Betrieb) | Eine Disziplin, die ML, DevOps und Dateningenieurwesen vereint, um den Modell-Lebenszyklus zu automatisieren und zu optimieren. |

| Datengravitation | Die Herausforderung, riesige Datensätze über Netzwerke zu bewegen. Lösung: Rechenleistung nahe an den Daten platzieren (z. B. vor Ort oder in regionalen Cloud-Zonen). |

| Modellbereitstellung / Inferenz | Der Prozess der Bereitstellung eines trainierten Modells zur Vorhersage. Kann in Echtzeit (APIs) oder im Batch-Modus (geplante Aufgaben) erfolgen. |

| Edge-KI | KI-Modelle direkt auf Edge-Geräten (Kameras, Sensoren, Smartphones) ausführen, um Latenz und Bandbreite zu reduzieren. |

| Skalierbarkeit und Kostenoptimierung | Verwendung von Auto-Scaling, Spot-Instanzen und effizienter Speicherung zur Verwaltung schwankender Workloads und zur Reduzierung der Cloud-Kosten. |

Diese Prinzipien leiten Architekten hin zu resistenten, effizienten und zukunftssicheren Designs.

🌐 Häufige Bereitstellungsmodelle

Wählen Sie das richtige Bereitstellungsmodell basierend auf Ihren geschäftlichen Anforderungen:

| Modell | Vorteile | Nachteile | Empfohlen für |

|---|---|---|---|

| Öffentliche Cloud | Schnelle Bereitstellung, unbegrenzte Skalierbarkeit, umfangreiche KI-Dienste (SageMaker, Vertex AI) | Mögliche Bedenken hinsichtlich der Datenhoheit | Startups, Innovations-Teams, skalierbare KI-Anwendungen |

| Private Cloud | Vollständige Kontrolle, erhöhte Sicherheit, Compliance | Hohe Einrichtungskosten, begrenzte Skalierbarkeit | Finanzinstitute, Regierungsbehörden |

| Hybrid-Cloud | Bietet Gleichgewicht zwischen Sicherheit und Flexibilität; ermöglicht den Wechsel von Workloads zwischen On-Premise und Cloud | Komplexe Integration | Unternehmen mit veralteten Systemen und strengen Compliance-Anforderungen |

| Multi-Cloud | Vermeidet Vendor-Lock-in, ermöglicht die optimale Dienstauswahl | Erhöhte Komplexität in der Verwaltung | Große Unternehmen, die Redundanz und Kosteneffizienz suchen |

🔄 Trend: Die meisten Unternehmen übernehmen Hybrid-/Multi-Cloud Strategien, um Agilität, Sicherheit und Kosten im Gleichgewicht zu halten.

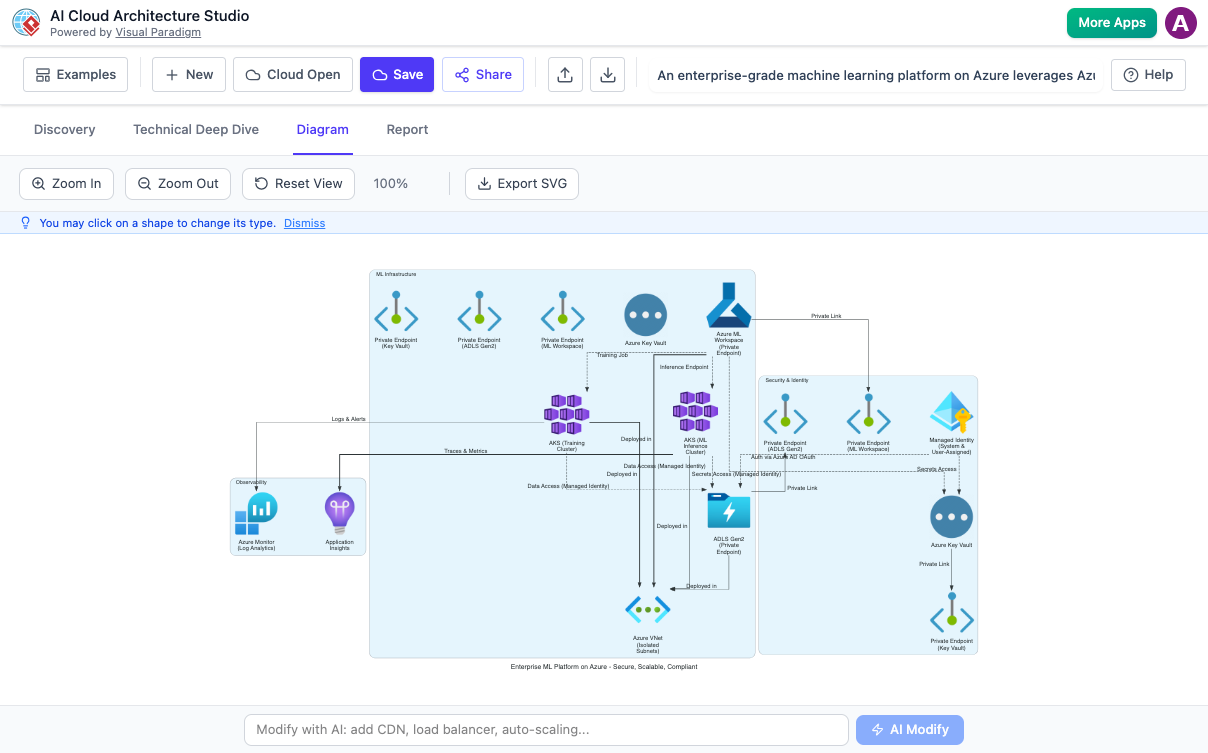

🛠️ Visual Paradigm’s AI-Cloud-Architektur-Studio: Ein Game-Changer

Da KI-Systeme an Komplexität gewinnen, wird visuelles Modellieren unverzichtbar. Treten Sie ein Visual Paradigm’s AI Cloud-Architektur-Studio—ein modernes Werkzeug, das entwickelt wurde, um die Gestaltung von künstlich-intelligenten Cloud-Architekturen zu vereinfachen und zu beschleunigen.

🌟 Funktionen und Fähigkeiten:

-

KI-gestütztes Modellieren: Generiert Architekturdiagramme aus natürlichen Sprachbefehlen.

-

Multi-Cloud-Unterstützung: Entwürfe für AWS, Azure, GCP und hybride Umgebungen.

-

Integrierte MLOps-Workflows: Visualisiert CI/CD-Pipelines, Modellversionierung und Überwachung.

-

Echtzeit-Kooperation: Teams können Architekturen in Echtzeit gemeinsam entwerfen und kommentieren.

-

Automatische Dokumentation: Generiert automatisch technische Dokumentation, Compliance-Berichte und Bereitstellungspläne.

📚 Ressourcen:

- AI Cloud-Architektur-Studio – Visual Paradigm: Eine offizielle Übersicht über die Funktionen des AI Cloud-Architektur-Studios von Visual Paradigm, die dessen Fähigkeiten, Multi-Cloud-Unterstützung und Integration in künstlich-intelligente Workflows beschreibt.

- Die Revolutionierung der Cloud-Design: Ein tiefgehender Einblick in Visual Paradigm’s AI Cloud-Architektur-Studio: Eine umfassende Analyse der KI-Fähigkeiten des Werkzeugs, seines Workflows und seiner Anwendungen in der Unternehmens-Cloud-Architektur.

- Ankündigung der Einführung des AI Cloud-Architektur-Studios: Die offiziellen Veröffentlichungshinweise von Visual Paradigm, die die Einführung des Werkzeugs im Februar 2026 ankündigen, einschließlich der wichtigsten Funktionen und der ersten Verfügbarkeit.

- AI Cloud-Architektur-Studio – Visual Paradigm AI-Portal: Das spezielle Web-Portal zum Zugriff auf das AI Cloud-Architektur-Studio, mit Live-Demos, Tutorials und Benutzerhandbüchern.

- AI Cloud-Architektur-Studio – AI-Toolbox von Visual Paradigm: Eine zentrale Plattform für künstlich-intelligente Modellierungswerkzeuge, einschließlich Zugriff auf das Cloud-Architektur-Studio und verwandte KI-Funktionen.