En la era de la inteligencia artificial (IA) y el aprendizaje automático (ML), las organizaciones ya no solo construyen aplicaciones, sino sistemas inteligentes capaces de aprender, adaptarse y ofrecer información en tiempo real. En el centro de esta transformación se encuentraArquitectura de nube de IA—un marco potente y diseñado específicamente que permite el desarrollo, entrenamiento, despliegue y gestión de cargas de trabajo de IA/ML a escala.

Esta guía completa explora la esencia de la arquitectura de nube de IA, sus componentes principales, casos de uso estratégicos, mejores prácticas de implementación, conceptos clave y modelos de despliegue, lo que permite a las empresas aprovechar todo el potencial de la IA en la nube.

🔷 ¿Qué es la arquitectura de nube de IA?

Arquitectura de nube de IAes el diseño estructural de una infraestructura escalable basada en la nube, compuesta por recursos de computación, almacenamiento y redes, específicamente optimizada para soportar cargas de trabajo de inteligencia artificial y aprendizaje automático. Sirve como columna vertebral para construir, entrenar, desplegar y gestionar modelos de IA de forma eficiente y segura.

✅ Definición:Es el marco—compuesto por infraestructura, gestión de datos y orquestación—que permite construir, entrenar y desplegar modelos de IA/ML a escala.

Esta arquitectura aprovecha hardware especializado comoGPUs (Unidades de procesamiento gráfico)yTPUs (Unidades de procesamiento de tensores), integra flujos de datos robustos y utiliza microservicios y orquestación de contenedores para ofrecer aplicaciones inteligentes, responsivas y escalables.

🧱 Capas fundamentales de la arquitectura de nube de IA

Una arquitectura de nube de IA bien diseñada consta de cinco capas fundamentales:

| Capa | Descripción |

|---|---|

| 1. Capa de infraestructura | Proporciona computación de alto rendimiento (GPUs/TPUs), redes escalables y almacenamiento resistente. Permite el procesamiento paralelo para el entrenamiento de modelos a gran escala. |

| 2. Capa de flujo de datos | Gestiona la ingesta, preprocesamiento, transformación y almacenamiento de datos de alta velocidad y alta volumetría provenientes de fuentes diversas (IoT, bases de datos, APIs). |

| 3. Capa de modelos de IA/ML | Alberga los modelos de aprendizaje automático—tanto preentrenados como personalizados—desarrollados utilizando marcos como TensorFlow, PyTorch o scikit-learn. |

| 4. Capa de orquestación y MLOps | Automatiza el ciclo de vida de los modelos mediante flujos de CI/CD, control de versiones, monitoreo y flujos de reentrenamiento. Construida sobre plataformas como Kubernetes, Argo o herramientas nativas de la nube para MLOps. |

| 5. Capa de aplicación y servicio | Ofrece capacidades de IA mediante APIs, servicios web, aplicaciones móviles o dispositivos de borde. Soporta inferencia en tiempo real y predicciones por lotes. |

Estas capas trabajan en armonía para crear una canalización fluida desde los datos hasta la toma de decisiones.

⚙️ Componentes clave de la arquitectura de IA en la nube

Para aprovechar todo el potencial de la IA en la nube, deben integrarse varios componentes críticos:

-

Kubernetes (K8s): El estándar de facto para la orquestación de contenedores, que permite la escalabilidad dinámica y la gestión de microservicios de IA.

-

Computación sin servidor: Ideal para cargas de trabajo de inferencia de IA, permitiendo escalabilidad automática y precios por uso (por ejemplo, AWS Lambda, Azure Functions).

-

Almacenamiento de alto rendimiento: Almacenamiento en bloques respaldado por SSD y almacenamiento de objetos (por ejemplo, S3, Cloud Storage) para acceso rápido a conjuntos de datos de entrenamiento.

-

Lagos de datos y almacenes de datos: Almacenes centralizados (por ejemplo, Amazon S3, Snowflake, Delta Lake) que almacenan datos estructurados e inestructurados en su forma original.

-

Plataformas de despliegue de modelos: Herramientas como TensorFlow Serving, TorchServe o soluciones gestionadas en la nube (por ejemplo, puntos finales de SageMaker) para inferencia con baja latencia.

-

Monitoreo y observabilidad: Seguimiento en tiempo real del rendimiento del modelo, detección de desviaciones, latencia y estado del sistema.

Estos componentes garantizan resiliencia, escalabilidad y eficiencia operativa a lo largo de todo el ciclo de vida de la IA.

📌 Cuándo usar la arquitectura de IA en la nube

La arquitectura de IA en la nube no es una solución de tamaño único, pero se vuelve esencial bajo condiciones específicas:

✅ Cargas de trabajo de alta demanda

Cuando su organización ejecutatrabajos de entrenamiento de IA intensivos en recursos—como modelos de lenguaje de gran tamaño (LLM), sistemas de visión por computadora o agentes de aprendizaje por refuerzo—necesita clusters escalables de GPU/TPU capaces de manejar terabytes de datos y millones de parámetros.

💡 Ejemplo:Entrenar un modelo de lenguaje de 100 mil millones de parámetros requiere cientos de GPUs y computación distribuida—solo factible con infraestructura a escala de nube.

✅ Inteligencia en tiempo real

Para aplicaciones que requierenrespuestas inmediatas, como detección de fraudes, vehículos autónomos o motores de recomendación en tiempo real, desplegar IA en elbordees crucial.

🌐 IA de borde: Mover la inferencia más cerca de las fuentes de datos (por ejemplo, sensores IoT, smartphones) reduce la latencia y el uso de ancho de banda.

✅ Flexibilidad híbrida/multi-nube

Las empresas con requisitos regulatorios estrictos o sistemas heredados se benefician de estrategias híbridas o multi-nube, donde las cargas de trabajo de IA pueden moverse de forma flexible entre centros de datos locales, nubes públicas (AWS, Azure, GCP) y nubes privadas, manteniendo el cumplimiento y la soberanía de los datos.

🔐 Casos de uso:Una empresa de salud entrena modelos localmente (para cumplir con HIPAA), pero despliega la inferencia en la nube pública para escalar.

🛠️ Cómo construir e implementar una arquitectura de nube de IA

Implementar una arquitectura de nube de IA requiere un enfoque estructurado y por fases. Siga estos cinco pasos:

1. Establecer una base de datos segura

-

Construir lagos de datos o almacenes de datos capaz de recibir datos en streaming y por lotes.

-

Implementar gobernanza de datos, seguimiento de la trazabilidad y controles de acceso.

-

Utilice herramientas como Apache Kafka, AWS Glue o Google Dataflow para la ingesta de datos en tiempo real.

2. Seleccionar la infraestructura de nube adecuada

Elija proveedores de nube y servicios adaptados para IA:

-

AWS: SageMaker, instancias GPU de EC2 (P4, G5), S3

-

Azure: Azure ML, máquinas virtuales GPU, Almacenamiento de blobs, Databricks

-

GCP: Vertex AI, pods de TPU, BigQuery, Almacenamiento en la Nube

🎯 Consejo: Opte por instancias optimizadas para GPU/TPU durante el entrenamiento; cambie a instancias de bajo costo o sin servidor para ahorrar costos durante la inferencia.

3. Implemente prácticas de MLOps

Automatice todo el ciclo de vida de la IA:

-

Control de versiones para datos, código y modelos (usando DVC, MLflow o Git).

-

Pipelines de CI/CD para reentrenamiento y despliegue de modelos.

-

Monitoreo de modelos para degradación del rendimiento, desviación de datos y sesgo.

🔄 MLOps = DevOps para la IA — Garantiza reproducibilidad, fiabilidad y trazabilidad.

4. Optimice el rendimiento y los costos

-

Use grupos de escalado automático para ajustar el cálculo según la demanda.

-

Aproveche instancias de bajo costo y VMs preemtibles para trabajos de entrenamiento no críticos.

-

Utilice compresión de datos, almacenamiento en caché, y almacenamiento en niveles para reducir costos.

5. Incorpore gobernanza y IA ética

Integre seguridad y cumplimiento desde el primer día:

-

Cifre los datos en reposo y en tránsito.

-

Implemente el control de acceso basado en roles (RBAC).

-

Monitoree el sesgo del modelo, la equidad y la explicabilidad (XAI).

-

Asegure el cumplimiento de regulaciones como el RGPD, CCPA, HIPAA.

🛡️ La gobernanza proactiva previene fallas costosas y daños a la reputación.

🔑 Conceptos clave en la arquitectura de nube de IA

Comprender estos conceptos fundamentales es crucial para diseñar sistemas de IA efectivos:

| Concepto | Explicación |

|---|---|

| MLOps (Operaciones de Aprendizaje Automático) | Una disciplina que combina el aprendizaje automático, DevOps e ingeniería de datos para automatizar y agilizar el ciclo de vida del modelo. |

| Gravedad de los datos | El desafío de mover grandes conjuntos de datos a través de redes. Solución: Coloque el procesamiento cerca de los datos (por ejemplo, en instalaciones propias o zonas de nube regionales). |

| Servicio de modelos / Inferencia | El proceso de desplegar un modelo entrenado para realizar predicciones. Puede ser en tiempo real (APIs) o por lotes (tareas programadas). |

| IA en el borde | Ejecutar modelos de IA directamente en dispositivos de borde (cámaras, sensores, teléfonos) para reducir la latencia y el ancho de banda. |

| Escalabilidad y optimización de costos | Utilizar escalado automático, instancias de bajo costo y almacenamiento eficiente para gestionar cargas de trabajo variables y reducir los gastos en la nube. |

Estos principios guían a los arquitectos hacia diseños resilientes, eficientes y preparados para el futuro.

🌐 Modelos de despliegue comunes

Elige el modelo de despliegue adecuado según tus necesidades empresariales:

| Modelo | Ventajas | Desventajas | Ideal para |

|---|---|---|---|

| Nube pública | Provisionamiento rápido, escalabilidad ilimitada y servicios de IA ricos (SageMaker, Vertex AI) | Posibles preocupaciones sobre la soberanía de los datos | Startups, equipos de innovación, aplicaciones de IA escalables |

| Nube privada | Control total, seguridad mejorada y cumplimiento | Alto costo de instalación, escalabilidad limitada | Instituciones financieras, agencias gubernamentales |

| Nube híbrida | Equilibra seguridad y flexibilidad; permite que las cargas de trabajo se muevan entre infraestructura local y la nube | Integración compleja | Empresas con sistemas heredados y necesidades estrictas de cumplimiento |

| Multi-nube | Evita el bloqueo del proveedor y permite la selección óptima de servicios | Mayor complejidad en la gestión | Grandes empresas que buscan redundancia y eficiencia de costos |

🔄 Tendencia: La mayoría de las empresas adoptan nube híbrida/multi-nube estrategias para equilibrar agilidad, seguridad y costos.

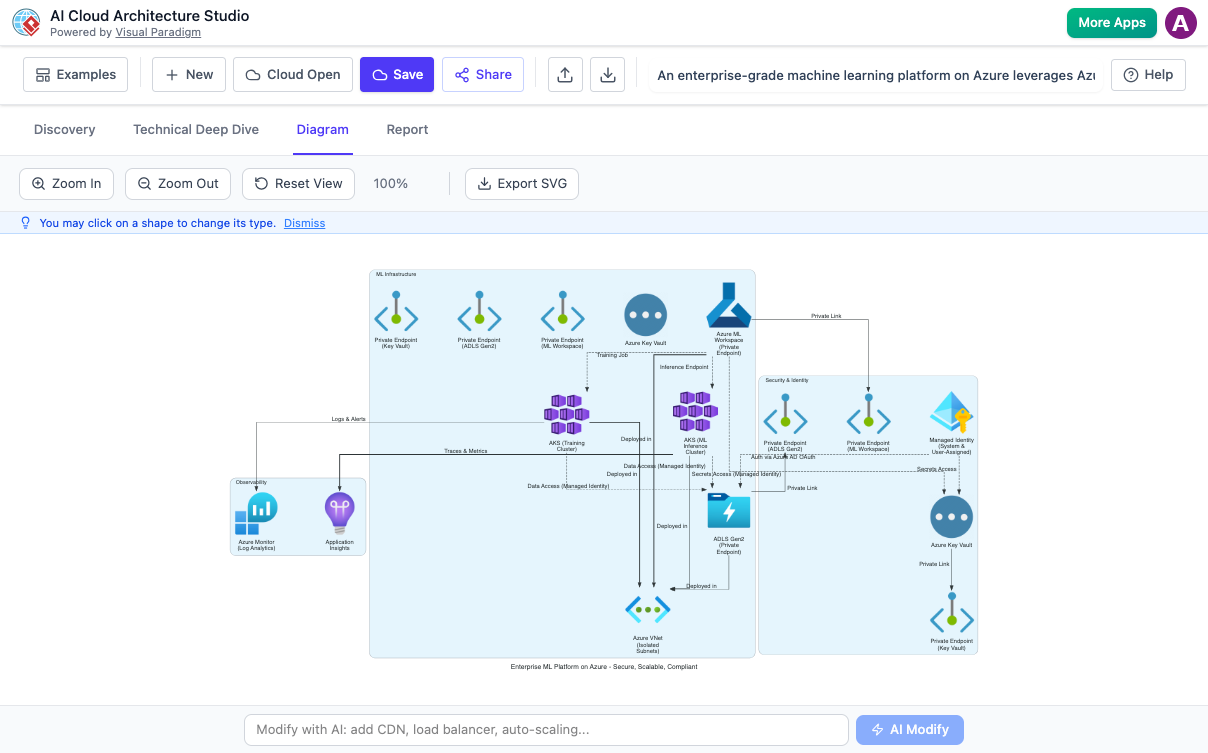

🛠️ Studio de Arquitectura en la Nube de IA de Visual Paradigm: Un cambio de juego

A medida que los sistemas de IA crecen en complejidad, la modelización visual se vuelve indispensable. Introducción de Estudio de Arquitectura en la Nube con IA de Visual Paradigm—una herramienta de vanguardia diseñada para simplificar y acelerar el diseño de arquitecturas en la nube impulsadas por IA.

🌟 Características y capacidades:

-

Modelado impulsado por IA: Genera diagramas de arquitectura a partir de comandos en lenguaje natural.

-

Soporte multi-nube: Diseño para AWS, Azure, GCP y entornos híbridos.

-

Flujos de trabajo integrados de MLOps: Visualiza pipelines de CI/CD, control de versiones de modelos y monitoreo.

-

Colaboración en tiempo real: Los equipos pueden diseñar conjuntamente y anotar arquitecturas en tiempo real.

-

Documentación automática: Genera automáticamente documentación técnica, informes de cumplimiento y planes de despliegue.

📚 Recursos:

- Estudio de Arquitectura en la Nube con IA – Visual Paradigm: Una descripción oficial de las características del Estudio de Arquitectura en la Nube con IA de Visual Paradigm, detallando sus capacidades, soporte multi-nube e integración con flujos de trabajo impulsados por IA.

- Revolucionando el diseño en la nube: una exploración profunda del Estudio de Arquitectura en la Nube con IA de Visual Paradigm: Un análisis completo de las capacidades de IA de la herramienta, su flujo de trabajo y sus aplicaciones en el mundo real en arquitectura en la nube empresarial.

- Anuncio del lanzamiento del Estudio de Arquitectura en la Nube con IA: Las notas oficiales de lanzamiento de Visual Paradigm, anunciando el lanzamiento de la herramienta en febrero de 2026, incluyendo sus características principales y disponibilidad inicial.

- Estudio de Arquitectura en la Nube con IA – Portal de IA de Visual Paradigm: El portal web dedicado para acceder al Estudio de Arquitectura en la Nube con IA, que incluye demostraciones en vivo, tutoriales y guías para usuarios.

- Estudio de Arquitectura en la Nube con IA – Caja de Herramientas de IA de Visual Paradigm: Una plataforma centralizada para herramientas de modelado impulsadas por IA, que incluye acceso al Estudio de Arquitectura en la Nube y características de IA relacionadas.