W erze sztucznej inteligencji (AI) i uczenia maszynowego (ML) organizacje nie budują już tylko aplikacji — budują systemy inteligentne zdolne do uczenia się, dostosowywania się i dostarczania w czasie rzeczywistym istotnych wskazówek. W centrum tej transformacji leżyArchitektura chmury AI—potężny, specjalnie zaprojektowany framework umożliwiający rozwój, szkolenie, wdrażanie i zarządzanie obciążeniami AI/ML w skali.

Ten kompleksowy przewodnik bada istotę architektury chmury AI, jej podstawowe komponenty, strategiczne zastosowania, najlepsze praktyki wdrażania, kluczowe koncepcje oraz modele wdrażania — umożliwiając przedsiębiorstwom wykorzystanie pełnego potencjału AI w chmurze.

🔷 Co to jest architektura chmury AI?

Architektura chmury AI to projekt strukturalny chmurowej, skalowalnej infrastruktury — składającej się z zasobów obliczeniowych, pamięci masowej i sieci — specjalnie zoptymalizowanej do obsługi obciążeń sztucznej inteligencji i uczenia maszynowego. Stanowi fundament do efektywnego i bezpiecznego budowania, szkolenia, wdrażania i zarządzania modelami AI.

✅ Definicja:To framework — składający się z infrastruktury, zarządzania danymi i koordynacji — umożliwiający budowę, szkolenie i wdrażanie modeli AI/ML w skali.

Ta architektura wykorzystuje specjalistyczną sprzętową taką jakGPU (jednostki przetwarzania graficznego) i TPU (jednostki przetwarzania tensorów), integruje wydajne potoki danych i wykorzystuje mikroserwisy oraz koordynację kontenerów w celu dostarczania inteligentnych, reaktywnych i skalowalnych aplikacji.

🧱 Podstawowe warstwy architektury chmury AI

Dobrze zaprojektowana architektura chmury AI składa się z pięciu podstawowych warstw:

| Warstwa | Opis |

|---|---|

| 1. Warstwa infrastruktury | Zapewnia wysokiej wydajności obliczenia (GPU/TPU), skalowalną sieć i odporną pamięć masową. Umożliwia przetwarzanie równoległe do szkolenia modeli w dużym zakresie. |

| 2. Warstwa potoków danych | Zarządza pobieraniem, przetwarzaniem wstępnym, przekształcaniem i przechowywaniem danych o wysokiej prędkości i dużym objętości z różnych źródeł (IoT, bazy danych, interfejsy API). |

| 3. Warstwa modeli AI/ML | Zawiera modele uczenia maszynowego — zarówno wstępnie wytrenowane, jak i niestandardowe — tworzone przy użyciu frameworków takich jak TensorFlow, PyTorch lub scikit-learn. |

| 4. Warstwa koordynacji i MLOps | Automatyzuje cykl życia modeli poprzez potoki CI/CD, wersjonowanie, monitorowanie i przepływy ponownego szkolenia. Budowana na platformach takich jak Kubernetes, Argo lub narzędziach MLOps dostosowanych do chmury. |

| 5. Warstwa aplikacji i dostarczania | Dostarcza możliwości AI za pośrednictwem interfejsów API, usług internetowych, aplikacji mobilnych lub urządzeń krawędziowych. Obsługuje wnioskowanie w czasie rzeczywistym oraz przewidywania partiami. |

Te warstwy działają w harmonii, tworząc płynny przepływ danych do podejmowania decyzji.

⚙️ Kluczowe komponenty architektury chmury AI

Aby wykorzystać pełen potencjał AI w chmurze, należy zintegrować kilka kluczowych komponentów:

-

Kubernetes (K8s): Powszechnie przyjęty standard zarządzania kontenerami, umożliwiający dynamiczne skalowanie i zarządzanie mikroserwisami AI.

-

Obliczenia bezserwerowe: Idealne dla obciążeń wnioskowania AI, umożliwiające automatyczne skalowanie i opłatę za wykorzystanie (np. AWS Lambda, Azure Functions).

-

Wysokiej wydajności przechowywanie danych: Magazynowanie blokowe wspierane przez SSD oraz magazynowanie obiektów (np. S3, Cloud Storage) zapewniające szybki dostęp do zestawów danych treningowych.

-

Jeziora danych i magazyny danych: Centralne repozytoria (np. Amazon S3, Snowflake, Delta Lake), które przechowują dane strukturalne i niestrukturalne w ich pierwotnej formie.

-

Platformy dostarczania modeli: Narzędzia takie jak TensorFlow Serving, TorchServe lub rozwiązania zarządzane w chmurze (np. punkty końcowe SageMaker) do wnioskowania o niskim opóźnieniu.

-

Monitorowanie i widoczność: Monitorowanie w czasie rzeczywistym wydajności modelu, wykrywanie odchyleń, opóźnień oraz stanu systemu.

Te komponenty zapewniają odporność, skalowalność i efektywność operacyjną na całym cyklu życia AI.

📌 Kiedy stosować architekturę chmury AI

Architektura chmury AI nie jest rozwiązaniem uniwersalnym – ale staje się niezbędna w określonych warunkach:

✅ Wysokie obciążenia

Gdy Twoja organizacja uruchamiaobciążenia AI wymagające dużych zasobów—takie jak duże modele językowe (LLM), systemy widzenia komputerowego lub agenty uczenia wzmacnianego — potrzebujesz skalowalnych klastrów GPU/TPU, które mogą przetwarzać terabajty danych i miliony parametrów.

💡 Przykład:Trening modelu językowego o 100 miliardach parametrów wymaga setek GPU i obliczeń rozproszonych — możliwe wyłącznie dzięki infrastrukturze o skali chmury.

✅ Inteligencja w czasie rzeczywistym

Dla aplikacji wymagającychnatychmiastowych odpowiedzi, takich jak wykrywanie oszustw, pojazdy samodzielne lub systemy rekomendacji w czasie rzeczywistym, wdrażanie AI na poziomiekrawędź jest kluczowy.

🌐 Edge AI: Przenoszenie wnioskowania bliżej źródeł danych (np. czujniki IoT, smartfony) zmniejsza opóźnienia i zużycie przepustowości.

✅ Elastyczność hybrydowa/multi-chmura

Przedsiębiorstwa z rygorystycznymi wymogami regulacyjnymi lub systemami dziedzicznymi korzystają z strategii hybrydowych lub multi-chmury, w których obciążenia AI mogą być elastycznie przenoszone między lokalnymi centrami danych, chmurami publicznymi (AWS, Azure, GCP) i prywatnymi chmurami — przy jednoczesnym zapewnieniu zgodności i suwerenności danych.

🔐 Przykład zastosowania: Dostawca usług medycznych trenuje modele lokalnie (w celu zgodności z HIPAA), ale wdraża wnioskowanie w chmurze publicznej dla skalowalności.

🛠️ Jak budować i wdrażać architekturę chmury AI

Wdrażanie architektury chmury AI wymaga strukturalnego, krokowego podejścia. Postępuj zgodnie z tymi pięcioma krokami:

1. Zbuduj bezpieczną podstawę danych

-

Zbuduj jeziora danych lub magazyny danych zdolne do przyjmowania danych strumieniowych i partii.

-

Zaimplementuj zarządzanie danymi, śledzenie pochodzenia danych i kontrole dostępu.

-

Użyj narzędzi takich jak Apache Kafka, AWS Glue lub Google Dataflow do pobierania danych w czasie rzeczywistym.

2. Wybierz odpowiednią infrastrukturę chmury

Wybierz dostawców chmury i usługi dostosowane do AI:

-

AWS: SageMaker, instancje GPU EC2 (P4, G5), S3

-

Azure: Azure ML, maszyny wirtualne z GPU, Blob Storage, Databricks

-

GCP: Vertex AI, pody TPU, BigQuery, Cloud Storage

🎯 Wskazówka: Wybierz instancje zoptymalizowane pod GPU/TPU podczas trenowania; przełącz na instancje spot lub bezserwerowe w celu oszczędności kosztów podczas wnioskowania.

3. Wprowadź praktyki MLOps

Zautomatyzuj cały cykl życia AI:

-

Kontrola wersji danych, kodu i modeli (z użyciem DVC, MLflow lub Git).

-

Ścieżki CI/CD do ponownego trenowania i wdrażania modeli.

-

Monitorowanie modeli pod kątem pogorszenia wydajności, przesunięcia danych i uprzedzeń.

🔄 MLOps = DevOps dla AI — zapewnia powtarzalność, niezawodność i śledzenie.

4. Optymalizuj pod kątem wydajności i kosztów

-

Użyj grupy automatycznego skalowania w celu dostosowania obliczeń do zapotrzebowania.

-

Wykorzystaj instancje spot i przerywane maszyny wirtualne dla niekrytycznych zadań trenowania.

-

Zastosuj kompresja danych, buforowanie, oraz przechowywanie w warstwach w celu zmniejszenia kosztów.

5. Zintegruj zarządzanie i etyczne AI

Zintegruj bezpieczeństwo i zgodność od pierwszego dnia:

-

Szyfruj dane w spoczynku i w tranzycie.

-

Zaimplementuj kontrolę dostępu opartą na rolach (RBAC).

-

Monitoruj obiektywizm modelu, sprawiedliwość i wyjaśnialność (XAI).

-

Zadbaj o zgodność z przepisami takimi jak RODO, CCPA, HIPAA.

🛡️ Proaktywne zarządzanie zapobiega kosztownym awariom i szkodzie dla reputacji.

🔑 Kluczowe koncepcje architektury chmury AI

Zrozumienie tych podstawowych koncepcji jest kluczowe dla projektowania skutecznych systemów AI:

| Koncepcja | Wyjaśnienie |

|---|---|

| MLOps (Operacje uczenia maszynowego) | Dziedzina łącząca uczenie maszynowe, DevOps i inżynierię danych w celu automatyzacji i optymalizacji cyklu życia modelu. |

| Grawitacja danych | Wyzwanie związane z przemieszczaniem ogromnych zbiorów danych przez sieci. Rozwiązanie: umieszczanie obliczeń blisko danych (np. lokalnie lub w regionalnych strefach chmury). |

| Serving modelu / wnioskowanie | Proces wdrażania wytrenowanego modelu w celu wykonywania prognoz. Może być w czasie rzeczywistym (interfejsy API) lub partiami (zadania harmonogramowe). |

| AI na krawędzi | Uruchamianie modeli AI bezpośrednio na urządzeniach krawędziowych (kamery, czujniki, telefony), aby zmniejszyć opóźnienia i zużycie przepustowości. |

| Skalowalność i optymalizacja kosztów | Wykorzystanie automatycznego skalowania, instancji przejściowych i efektywnego przechowywania danych w celu zarządzania zmiennymi obciążeniami i zmniejszenia kosztów chmury. |

Te zasady prowadzą architektów ku projektom odpornym, wydajnym i przyszłościowym.

🌐 Powszechnie stosowane modele wdrażania

Wybierz odpowiedni model wdrażania na podstawie potrzeb Twojej firmy:

| Model | Zalety | Wady | Najlepsze dla |

|---|---|---|---|

| Chmura publiczna | Szybka dystrybucja, nieograniczona skalowalność, bogate usługi AI (SageMaker, Vertex AI) | Potencjalne problemy z suwerennością danych | Startupi, zespoły innowacyjne, skalowalne aplikacje AI |

| Chmura prywatna | Pełna kontrola, zwiększone bezpieczeństwo, zgodność | Wysokie koszty wdrożenia, ograniczona skalowalność | Instytucje finansowe, agencje rządowe |

| Chmura hybrydowa | Zrównoważenie bezpieczeństwa i elastyczności; umożliwia przenoszenie obciążeń między lokalnymi systemami a chmurą | Złożona integracja | Przedsiębiorstwa z systemami dziedzicznymi i rygorystycznymi wymogami zgodności |

| Wielochmura | Unika zależności od dostawcy, umożliwia optymalny wybór usług | Zwiększona złożoność zarządzania | Duże przedsiębiorstwa poszukujące redundancji i efektywności kosztowej |

🔄 Trend: Największość przedsiębiorstw wybiera hybrydową/wielochmurę strategie, aby zrównoważyć zwinność, bezpieczeństwo i koszty.

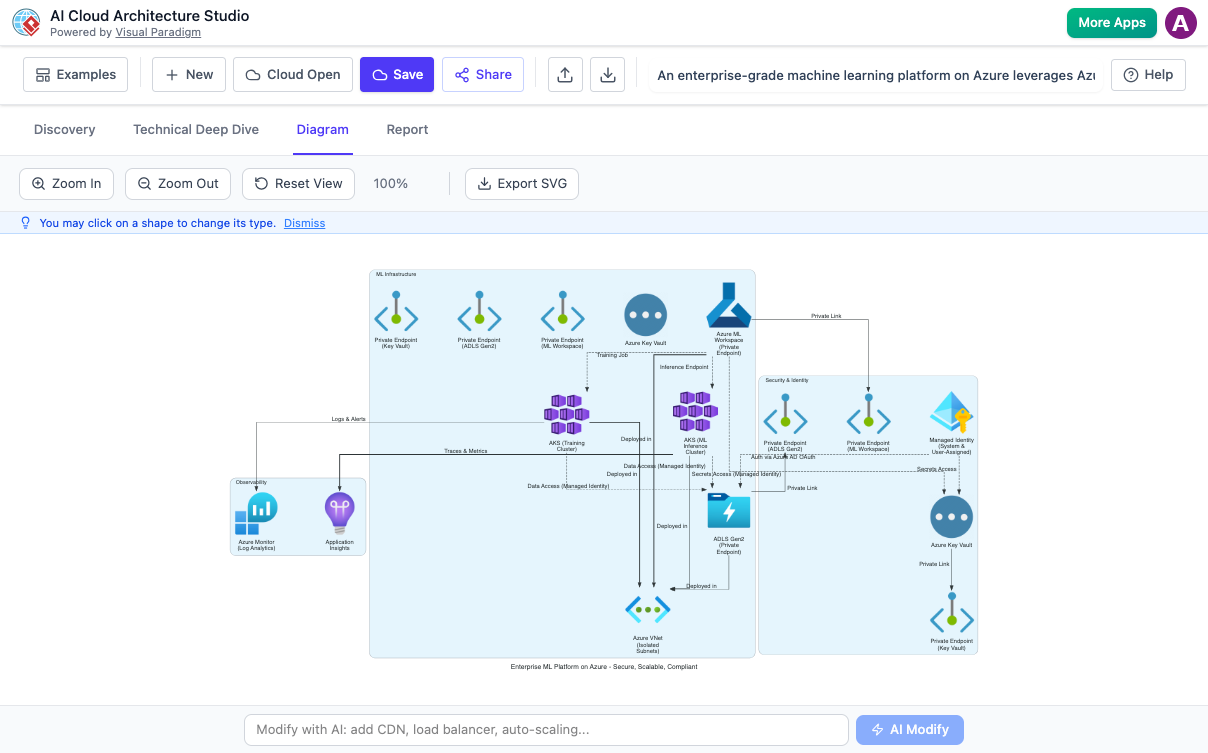

🛠️ Visual Paradigm’s AI Cloud Architecture Studio: Przegląd

Wraz z rosnącą złożonością systemów AI, modelowanie wizualne staje się nieodzowne. Przyjdź Studio architektury chmury AI firmy Visual Paradigm—nowoczesne narzędzie zaprojektowane w celu uproszczenia i przyspieszenia projektowania architektury chmury opartej na AI.

🌟 Funkcje i możliwości:

-

Modelowanie z wykorzystaniem AI: Generuje diagramy architektury na podstawie poleceń w języku naturalnym.

-

Wsparcie dla wielu chmur: Projektuje dla AWS, Azure, GCP oraz środowisk hybrydowych.

-

Zintegrowane przepływy pracy MLOps: Wizualizuje przepływy CI/CD, wersjonowanie modeli oraz monitorowanie.

-

Współpraca w czasie rzeczywistym: Zespoły mogą wspólnie projektować i komentować architektury w czasie rzeczywistym.

-

Automatyczna dokumentacja: Automatycznie generuje dokumentację techniczną, raporty zgodności oraz plany wdrożenia.

📚 Zasoby:

- Studio architektury chmury AI – Visual Paradigm: Oficjalny przegląd funkcji Studio architektury chmury AI firmy Visual Paradigm, opisujący jego możliwości, wsparcie dla wielu chmur oraz integrację z przepływami pracy opartymi na AI.

- Rewolucja w projektowaniu chmury: głęboka analiza Studio architektury chmury AI firmy Visual Paradigm: Kompleksowa analiza możliwości AI narzędzia, przepływu pracy oraz zastosowań w rzeczywistych projektach architektury chmury w przedsiębiorstwach.

- Ogłoszenie uruchomienia Studio architektury chmury AI: Oficjalne notatki wydania od firmy Visual Paradigm, ogłaszające uruchomienie narzędzia w lutym 2026 roku, w tym kluczowe funkcje i początkową dostępność.

- Studio architektury chmury AI – Portal AI firmy Visual Paradigm: Specjalistyczny portal internetowy do uzyskania dostępu do Studio architektury chmury AI, z funkcjami demonstracji na żywo, poradnikami i przewodnikami dla użytkowników.

- Studio architektury chmury AI – Skrzynka narzędzi AI firmy Visual Paradigm: Centralny ośrodek narzędzi do modelowania opartego na AI, obejmujący dostęp do Studio architektury chmury oraz powiązanych funkcji AI.