Di era kecerdasan buatan (AI) dan pembelajaran mesin (ML), organisasi tidak lagi hanya membangun aplikasi—mereka membangun sistem cerdas yang mampu belajar, beradaptasi, dan memberikan wawasan secara real-time. Di inti transformasi ini terletak padaArsitektur Cloud AI—kerangka kerja yang kuat dan dirancang khusus yang memungkinkan pengembangan, pelatihan, penyebaran, dan manajemen beban kerja AI/ML secara skala besar.

Panduan komprehensif ini mengeksplorasi inti dari arsitektur cloud AI, komponen utamanya, kasus penggunaan strategis, praktik terbaik implementasi, konsep kunci, dan model penyebaran—memberdayakan perusahaan untuk memanfaatkan potensi penuh AI di cloud.

🔷 Apa Itu Arsitektur Cloud AI?

Arsitektur Cloud AIadalah desain struktural dari infrastruktur berbasis cloud yang dapat diperbesar—yang terdiri dari sumber daya komputasi, penyimpanan, dan jaringan—secara khusus dioptimalkan untuk mendukung beban kerja Kecerdasan Buatan dan Pembelajaran Mesin. Ini berfungsi sebagai tulang punggung untuk membangun, melatih, menyebar, dan mengelola model AI secara efisien dan aman.

✅ Definisi:Ini adalah kerangka kerja—yang terdiri dari infrastruktur, manajemen data, dan orkestrasi—yang memungkinkan model AI/ML dibangun, dilatih, dan disebar secara skala besar.

Arsitektur ini memanfaatkan perangkat keras khusus sepertiGPU (Unit Pemrosesan Grafis)danTPU (Unit Pemrosesan Tensor), mengintegrasikan saluran data yang kuat, dan menggunakan mikroservis serta orkestrasi container untuk menghadirkan aplikasi yang cerdas, responsif, dan dapat diperbesar.

🧱 Lapisan Inti dari Arsitektur Cloud AI

Arsitektur cloud AI yang dirancang dengan baik terdiri dari lima lapisan dasar:

| Lapisan | Deskripsi |

|---|---|

| 1. Lapisan Infrastruktur | Menyediakan komputasi berkinerja tinggi (GPU/TPU), jaringan yang dapat diperbesar, dan penyimpanan yang tangguh. Memungkinkan pemrosesan paralel untuk pelatihan model skala besar. |

| 2. Lapisan Saluran Data | Mengelola pengambilan, pra-pemrosesan, transformasi, dan penyimpanan data berkecepatan tinggi dan volume besar dari berbagai sumber (IoT, basis data, API). |

| 3. Lapisan Model AI/ML | Menampung model pembelajaran mesin—baik yang sudah dilatih sebelumnya maupun yang disesuaikan—yang dikembangkan menggunakan kerangka kerja seperti TensorFlow, PyTorch, atau scikit-learn. |

| 4. Lapisan Orkestrasi & MLOps | Mengotomatisasi siklus hidup model melalui saluran CI/CD, pengelolaan versi, pemantauan, dan alur kerja pelatihan ulang. Dibangun di atas platform seperti Kubernetes, Argo, atau alat MLOps berbasis cloud. |

| 5. Lapisan Aplikasi dan Penyediaan | Menyediakan kemampuan AI melalui API, layanan web, aplikasi mobile, atau perangkat tepi. Mendukung inferensi secara real-time dan prediksi dalam jumlah besar. |

Lapisan-lapisan ini bekerja secara harmonis untuk menciptakan alur yang mulus dari data hingga pengambilan keputusan.

⚙️ Komponen Utama Arsitektur AI Cloud

Untuk mewujudkan seluruh kekuatan AI di cloud, beberapa komponen kritis harus diintegrasikan:

-

Kubernetes (K8s): Standar de facto untuk orkestrasi container, memungkinkan peningkatan skala dinamis dan manajemen layanan mikro AI.

-

Komputasi Tanpa Server: Ideal untuk beban kerja inferensi AI, memungkinkan peningkatan skala otomatis dan pembayaran berdasarkan penggunaan (misalnya, AWS Lambda, Azure Functions).

-

Penyimpanan Berkinerja Tinggi: Penyimpanan blok berbasis SSD dan penyimpanan objek (misalnya, S3, Cloud Storage) untuk akses cepat ke dataset pelatihan.

-

Danau Data & Gudang Data: Repositori terpusat (misalnya, Amazon S3, Snowflake, Delta Lake) yang menyimpan data terstruktur dan tidak terstruktur dalam bentuk mentahnya.

-

Platform Penyediaan Model: Alat seperti TensorFlow Serving, TorchServe, atau solusi yang dikelola cloud (misalnya, SageMaker Endpoints) untuk inferensi dengan latensi rendah.

-

Pemantauan & Observabilitas: Pelacakan real-time kinerja model, deteksi penyimpangan, latensi, dan kesehatan sistem.

Komponen-komponen ini menjamin ketahanan, skalabilitas, dan efisiensi operasional sepanjang siklus hidup AI.

📌 Kapan Menggunakan Arsitektur AI Cloud

Arsitektur AI cloud bukan solusi seragam untuk semua kebutuhan—tetapi menjadi penting dalam kondisi-kondisi tertentu:

✅ Beban Kerja Berkebutuhan Tinggi

Ketika organisasi Anda menjalankan pekerjaan pelatihan AI yang intensif sumber daya—seperti model bahasa besar (LLM), sistem visi komputer, atau agen pembelajaran penguatan—Anda memerlukan klaster GPU/TPU yang dapat diskalakan untuk menangani terabita data dan jutaan parameter.

💡 Contoh: Melatih LLM dengan parameter 100 miliar membutuhkan ratusan GPU dan komputasi terdistribusi—hanya layak dilakukan dengan infrastruktur skala cloud.

✅ Kecerdasan Real-Time

Untuk aplikasi yang membutuhkan respon segera, seperti deteksi penipuan, kendaraan otonom, atau mesin rekomendasi real-time, menempatkan AI di edge sangat penting.

🌐 AI Edge: Memindahkan inferensi lebih dekat ke sumber data (misalnya, sensor IoT, ponsel pintar) mengurangi latensi dan penggunaan bandwidth.

✅ Fleksibilitas Hybrid/Multi-Cloud

Perusahaan dengan persyaratan regulasi yang ketat atau sistem lama mendapatkan manfaat dari strategi hybrid atau multi-cloud, di mana beban kerja AI dapat dengan fleksibel dipindahkan antara pusat data lokal, cloud publik (AWS, Azure, GCP), dan cloud pribadi—sambil tetap mempertahankan kepatuhan dan kedaulatan data.

🔐 Kasus Penggunaan: Sebuah penyedia layanan kesehatan melatih model secara lokal (untuk kepatuhan HIPAA) tetapi menerapkan inferensi di cloud publik untuk skalabilitas.

🛠️ Cara Membangun & Menerapkan Arsitektur Cloud AI

Menerapkan arsitektur cloud AI membutuhkan pendekatan terstruktur dan berjenjang. Ikuti lima langkah berikut:

1. Tetapkan Fondasi Data yang Aman

-

Bangun danau data atau gudang data yang mampu menangkap data streaming dan batch.

-

Terapkan tata kelola data, pelacakan asal data, dan kontrol akses.

-

Gunakan alat seperti Apache Kafka, AWS Glue, atau Google Dataflow untuk pengambilan data real-time.

2. Pilih Infrastruktur Cloud yang Tepat

Pilih penyedia cloud dan layanan yang dirancang khusus untuk AI:

-

AWS: SageMaker, instans GPU EC2 (P4, G5), S3

-

Azure: Azure ML, VM GPU, Blob Storage, Databricks

-

GCP: Vertex AI, pod TPU, BigQuery, Penyimpanan Cloud

🎯 Kiat: Pilih instans yang dioptimalkan untuk GPU/TPU selama pelatihan; beralih ke instans spot atau tanpa server untuk penghematan biaya selama inferensi.

3. Terapkan Praktik MLOps

Otomatisasi seluruh siklus hidup AI:

-

Kontrol versi untuk data, kode, dan model (menggunakan DVC, MLflow, atau Git).

-

Pipeline CI/CD untuk pelatihan ulang model dan penyebaran.

-

Pemantauan model untuk penurunan kinerja, pergeseran data, dan bias.

🔄 MLOps = DevOps untuk AI — Menjamin kemampuan direplikasi, keandalan, dan pelacakan.

4. Optimalkan untuk Kinerja & Biaya

-

Gunakan kelompok penyesuaian otomatis untuk menyesuaikan komputasi berdasarkan permintaan.

-

Manfaatkan instans spot dan VM yang dapat dihentikan untuk pekerjaan pelatihan yang tidak kritis.

-

Gunakan kompresi data, penyimpanan sementara, dan penyimpanan berjenjang untuk mengurangi biaya.

5. Integrasikan Tata Kelola & Kecerdasan Buatan Etis

Integrasikan keamanan dan kepatuhan sejak hari pertama:

-

Enkripsi data yang disimpan dan sedang dalam perjalanan.

-

Terapkan kontrol akses berbasis peran (RBAC).

-

Pantau bias model, keadilan, dan kemampuan penjelasan (XAI).

-

Pastikan kepatuhan terhadap peraturan seperti GDPR, CCPA, HIPAA.

🛡️ Tata kelola proaktif mencegah kegagalan yang mahal dan kerusakan reputasi.

🔑 Konsep Kunci dalam Arsitektur Awan Kecerdasan Buatan

Memahami konsep-konsep dasar ini sangat penting untuk merancang sistem Kecerdasan Buatan yang efektif:

| Konsep | Penjelasan |

|---|---|

| MLOps (Operasi Pembelajaran Mesin) | Disiplin yang menggabungkan ML, DevOps, dan rekayasa data untuk mengotomatisasi dan mempercepat siklus hidup model. |

| Gravitasi Data | Tantangan memindahkan dataset besar melintasi jaringan. Solusi: Tempatkan komputasi dekat data (misalnya, di tempat sendiri atau zona awan regional). |

| Penyediaan Model / Inferensi | Proses menempatkan model yang telah dilatih untuk membuat prediksi. Dapat dilakukan secara real-time (API) atau batch (pekerjaan yang dijadwalkan). |

| Kecerdasan Buatan di Tepi | Menjalankan model Kecerdasan Buatan langsung di perangkat tepi (kamera, sensor, ponsel) untuk mengurangi latensi dan bandwidth. |

| Skalabilitas & Optimalisasi Biaya | Menggunakan auto-scaling, instance spot, dan penyimpanan yang efisien untuk mengelola beban kerja yang bervariasi dan mengurangi pengeluaran awan. |

Prinsip-prinsip ini membimbing arsitek menuju desain yang tangguh, efisien, dan siap menghadapi masa depan.

🌐 Model Penempatan Umum

Pilih model penempatan yang tepat berdasarkan kebutuhan bisnis Anda:

| Model | Kelebihan | Kekurangan | Terbaik untuk |

|---|---|---|---|

| Cloud Publik | Penyediaan cepat, skalabilitas tak terbatas, layanan AI kaya (SageMaker, Vertex AI) | Kekhawatiran potensial mengenai kedaulatan data | Startup, tim inovasi, aplikasi AI yang dapat diskalakan |

| Cloud Pribadi | Kontrol penuh, keamanan yang ditingkatkan, kepatuhan | Biaya setup tinggi, skalabilitas terbatas | Lembaga keuangan, lembaga pemerintah |

| Cloud Hibrida | Menyeimbangkan keamanan dan fleksibilitas; memungkinkan beban kerja berpindah antara on-prem dan cloud | Integrasi yang kompleks | Perusahaan dengan sistem warisan dan kebutuhan kepatuhan yang ketat |

| Multi-Cloud | Menghindari ketergantungan pada penyedia, memungkinkan pemilihan layanan terbaik | Kompleksitas manajemen yang meningkat | Perusahaan besar yang mencari redundansi dan efisiensi biaya |

🔄 Tren: Kebanyakan perusahaan mengadopsi hibrida/multi-cloud strategi untuk menyeimbangkan agilitas, keamanan, dan biaya.

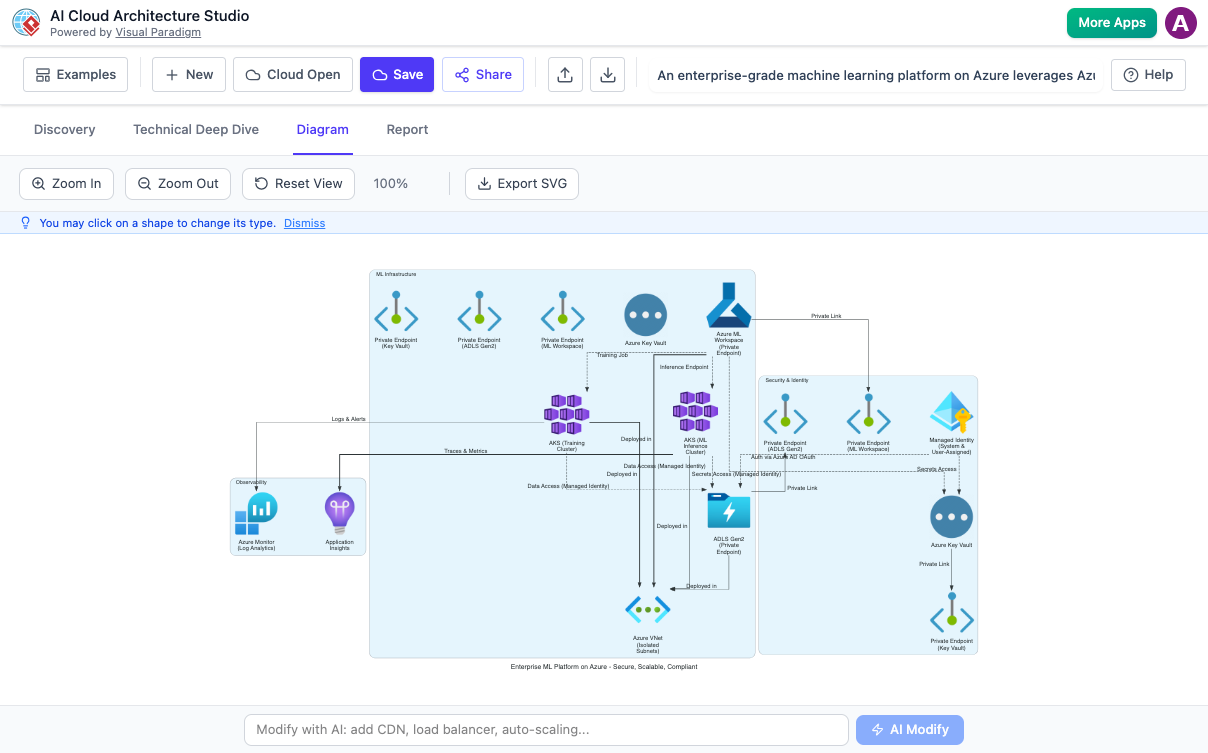

🛠️ Studio Arsitektur Cloud AI Visual Paradigm: Perubahan Besar

Seiring sistem AI semakin kompleks, pemodelan visual menjadi tak terhindarkan. Masuklah Studio Arsitektur Cloud Berbasis AI Visual Paradigm—alat mutakhir yang dirancang untuk menyederhanakan dan mempercepat desain arsitektur cloud yang didorong oleh AI.

🌟 Fitur & Kemampuan:

-

Pemodelan Berbasis AI: Menghasilkan diagram arsitektur dari petunjuk bahasa alami.

-

Dukungan Multi-Cloud: Dirancang untuk AWS, Azure, GCP, dan lingkungan hibrida.

-

Alur Kerja MLOps Terintegrasi: Memvisualisasikan alur CI/CD, pengelolaan versi model, dan pemantauan.

-

Kolaborasi Secara Real-Time: Tim dapat merancang bersama dan memberi anotasi arsitektur secara real-time.

-

Dokumentasi Otomatis: Secara otomatis menghasilkan dokumentasi teknis, laporan kepatuhan, dan rencana penempatan.

📚 Sumber Daya:

- Studio Arsitektur Cloud Berbasis AI – Visual Paradigm: Ringkasan fitur resmi dari Studio Arsitektur Cloud Berbasis AI Visual Paradigm, menjelaskan kemampuannya, dukungan multi-cloud, dan integrasi dengan alur kerja berbasis AI.

- Merevolusi Desain Cloud: Tinjauan Mendalam ke Studio Arsitektur Cloud Berbasis AI Visual Paradigm: Analisis komprehensif tentang kemampuan AI alat ini, alur kerja, dan aplikasi dunia nyata dalam arsitektur cloud perusahaan.

- Pengumuman Peluncuran Studio Arsitektur Cloud Berbasis AI: Catatan rilis resmi dari Visual Paradigm, mengumumkan peluncuran alat ini pada Februari 2026, termasuk fitur utama dan ketersediaan awal.

- Studio Arsitektur Cloud Berbasis AI – Portal AI Visual Paradigm: Portal web khusus untuk mengakses Studio Arsitektur Cloud Berbasis AI, menampilkan demo langsung, tutorial, dan panduan pengguna.

- Studio Arsitektur Cloud Berbasis AI – Kotak Alat AI oleh Visual Paradigm: Pusat terpadu untuk alat pemodelan berbasis AI, termasuk akses ke Studio Arsitektur Cloud dan fitur AI terkait.