在人工智能(AI)和机器学习(ML)的时代,组织不再仅仅构建应用程序——他们正在构建能够学习、适应并提供实时洞察的智能系统。这一变革的核心在于人工智能云架构——一个功能强大、专为特定目的设计的框架,能够实现人工智能/机器学习工作负载的大规模开发、训练、部署和管理。

本全面指南探讨了人工智能云架构的本质、核心组件、战略应用场景、实施最佳实践、关键概念以及部署模式,助力企业充分挖掘人工智能在云中的全部潜力。

🔷 什么是人工智能云架构?

人工智能云架构是基于云的可扩展基础设施的结构设计——包括计算、存储和网络资源——专门优化以支持人工智能和机器学习工作负载。它作为构建、训练、部署和安全高效管理人工智能模型的骨干。

✅ 定义:它是一个框架,包括基础设施、数据管理和编排,使人工智能/机器学习模型能够大规模地构建、训练和部署。

该架构利用专用硬件,例如GPU(图形处理单元)和TPU(张量处理单元),集成强大的数据流水线,并采用微服务和容器编排技术,以交付智能、响应迅速且可扩展的应用程序。

🧱 人工智能云架构的核心层级

一个设计良好的人工智能云架构由五个基础层级组成:

| 层级 | 描述 |

|---|---|

| 1. 基础设施层 | 提供高性能计算(GPU/TPU)、可扩展网络和高韧性存储。支持大规模模型训练的并行处理。 |

| 2. 数据流水线层 | 管理来自多种来源(物联网、数据库、API)的高速、海量数据的采集、预处理、转换和存储。 |

| 3. 人工智能/机器学习模型层 | 容纳使用TensorFlow、PyTorch或scikit-learn等框架开发的预训练和自定义机器学习模型。 |

| 4. 编排与MLOps层 | 通过CI/CD流水线、版本控制、监控和重新训练工作流,自动化模型生命周期。基于Kubernetes、Argo或原生云MLOps工具等平台构建。 |

| 5. 应用与服务层 | 通过API、Web服务、移动应用或边缘设备提供AI功能。支持实时推理和批量预测。 |

这些层级协同工作,从数据到决策形成无缝的流程。

⚙️ AI云架构的关键组件

要充分发挥云中AI的全部潜力,必须集成多个关键组件:

-

Kubernetes (K8s):容器编排的事实标准,支持AI微服务的动态扩展和管理。

-

无服务器计算:适用于AI推理工作负载,支持自动扩展和按使用量计费(例如AWS Lambda、Azure Functions)。

-

高性能存储:基于SSD的块存储和对象存储(例如S3、云存储),用于快速访问训练数据集。

-

数据湖与数据仓库:集中式存储库(例如Amazon S3、Snowflake、Delta Lake),以原始形式存储结构化和非结构化数据。

-

模型服务化平台:如TensorFlow Serving、TorchServe或云托管解决方案(例如SageMaker端点)等工具,用于低延迟推理。

-

监控与可观测性:实时跟踪模型性能、漂移检测、延迟和系统健康状况。

这些组件确保AI生命周期中的韧性、可扩展性和运营效率。

📌 何时使用AI云架构

AI云架构并非万能方案,但在特定条件下变得至关重要:

✅ 高需求工作负载

当您的组织运行资源密集型AI训练任务——例如大型语言模型(LLMs)、计算机视觉系统或强化学习代理——您需要可扩展的GPU/TPU集群,以处理TB级数据和数百万个参数。

💡 示例:训练一个1000亿参数的LLM需要数百个GPU和分布式计算——只有在云规模基础设施下才可行。

✅ 实时智能

对于需要即时响应的应用场景,例如欺诈检测、自动驾驶汽车或实时推荐引擎,需要在边缘至关重要。

🌐 边缘人工智能: 将推理靠近数据源(例如物联网传感器、智能手机)可以降低延迟并减少带宽使用。

✅ 混合云/多云灵活性

具有严格监管要求或遗留系统的企事业单位可从 混合云或多云策略中获益,人工智能工作负载可以在本地数据中心、公有云(AWS、Azure、GCP)和私有云之间灵活迁移,同时保持合规性和数据主权。

🔐 应用场景:一家医疗保健提供商在本地训练模型(以符合HIPAA要求),但将推理部署在公有云以实现可扩展性。

🛠️ 如何构建与实施人工智能云架构

实施人工智能云架构需要结构化、分阶段的方法。请遵循以下五个步骤:

1. 建立安全的数据基础

-

构建 数据湖或 数据仓库,能够接收流式和批量数据。

-

实施数据治理、数据血缘追踪和访问控制。

-

使用Apache Kafka、AWS Glue或Google Dataflow等工具实现实时数据摄入。

2. 选择合适的云基础设施

选择专为人工智能设计的云服务商和云服务:

-

AWS: SageMaker,EC2 GPU实例(P4、G5),S3

-

Azure: Azure ML,GPU虚拟机,Blob存储,Databricks

-

GCP: Vertex AI,TPU集群,BigQuery,Cloud Storage

🎯 提示: 选择 GPU/TPU优化实例 在训练期间;切换到 按需实例 或 无服务器 以在推理期间节省成本。

3. 实施MLOps实践

自动化整个AI生命周期:

-

数据、代码和模型的版本控制(使用DVC、MLflow或Git)。

-

用于模型重新训练和部署的CI/CD流水线。

-

对性能下降、数据漂移和偏差进行模型监控。

🔄 MLOps = AI领域的DevOps — 确保可复现性、可靠性和可追溯性。

4. 优化性能与成本

-

使用 自动伸缩组 根据需求调整计算资源。

-

利用 按需实例 和 可抢占虚拟机 用于非关键的训练任务。

-

采用数据压缩, 缓存,以及分层存储以降低成本。

5. 嵌入治理与伦理AI

从第一天起就集成安全与合规:

-

对静态数据和传输中的数据进行加密。

-

实施基于角色的访问控制(RBAC)。

-

监控模型偏差、公平性与可解释性(XAI)。

-

确保遵守GDPR、CCPA、HIPAA等法规。

🛡️ 主动治理可防止昂贵的失败和声誉损害。

🔑 人工智能云架构中的关键概念

理解这些基础概念对于设计有效的AI系统至关重要:

| 概念 | 解释 |

|---|---|

| MLOps(机器学习运维) | 一种结合机器学习、DevOps和数据工程的学科,用于自动化和优化模型生命周期。 |

| 数据引力 | 在不同网络间移动大规模数据集的挑战。解决方案:将计算资源靠近数据(例如本地部署或区域云区域)。 |

| 模型服务/推理 | 将训练好的模型部署以进行预测的过程。可以是实时的(API)或批量的(定时任务)。 |

| 边缘AI | 在边缘设备(摄像头、传感器、手机)上直接运行AI模型,以降低延迟和带宽消耗。 |

| 可扩展性与成本优化 | 利用自动扩展、抢占式实例和高效存储来管理可变工作负载并降低云支出。 |

这些原则指导建筑师打造具有韧性、高效且面向未来的设计方案。

🌐 常见的部署模式

根据您的业务需求选择合适的部署模式:

| 模式 | 优点 | 缺点 | 最适合 |

|---|---|---|---|

| 公有云 | 快速部署、无限扩展性、丰富的AI服务(SageMaker、Vertex AI) | 潜在的数据主权问题 | 初创企业、创新团队、可扩展的AI应用 |

| 私有云 | 完全控制、增强的安全性、合规性 | 高设置成本、扩展性有限 | 金融机构、政府机构 |

| 混合云 | 平衡安全与灵活性;支持工作负载在本地与云之间迁移 | 集成复杂 | 拥有遗留系统和严格合规需求的企业 |

| 多云 | 避免供应商锁定,支持最优服务选择 | 管理复杂度增加 | 寻求冗余和成本效益的大型企业 |

🔄 趋势: 大多数企业采用 混合/多云 策略以平衡敏捷性、安全性和成本。

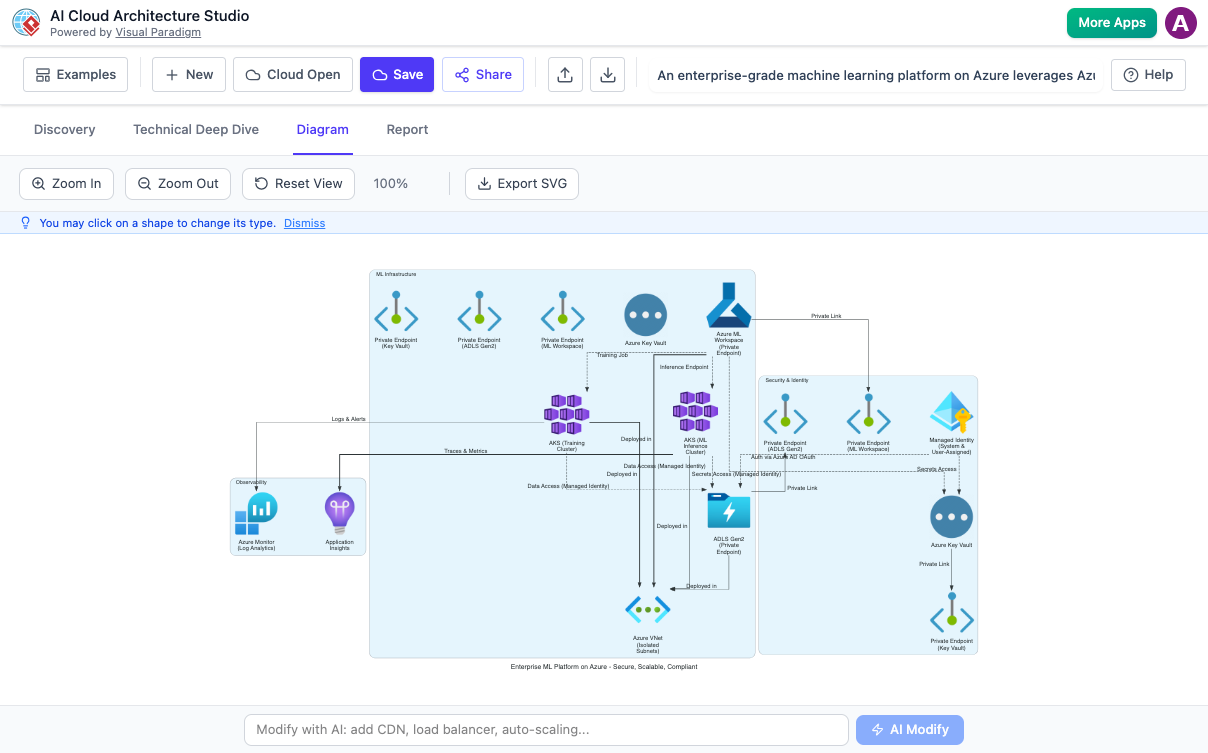

🛠️ Visual Paradigm 的 AI 云架构工作室:变革性工具

随着AI系统复杂性的增加,可视化建模变得不可或缺。现在登场的是 Visual Paradigm 的 AI 云架构工作室——一款前沿工具,旨在简化并加速 AI 驱动的云架构设计。

🌟 特性与功能:

-

AI 驱动的建模:可根据自然语言提示生成架构图。

-

多云支持:支持 AWS、Azure、GCP 及混合环境的设计。

-

集成的 MLOps 工作流:可视化 CI/CD 流水线、模型版本控制和监控。

-

实时协作:团队可实时共同设计并标注架构。

-

自动文档生成:自动生成技术文档、合规报告和部署计划。

📚 资源:

- AI 云架构工作室 – Visual Paradigm:Visual Paradigm AI 云架构工作室的官方功能概览,详细介绍其功能、多云支持以及与 AI 驱动工作流的集成。

- 革新云设计:深入解析 Visual Paradigm 的 AI 云架构工作室:对该工具 AI 能力、工作流程以及在企业云架构中实际应用的全面分析。

- AI 云架构工作室发布公告:Visual Paradigm 官方发布的版本说明,宣布该工具将于 2026 年 2 月上线,包含核心功能及初始可用性信息。

- AI 云架构工作室 – Visual Paradigm AI 门户:用于访问 AI 云架构工作室的专用网页门户,提供实时演示、教程和用户指南。

- AI 云架构工作室 – Visual Paradigm 的 AI 工具箱:AI 驱动建模工具的集中枢纽,包括对云架构工作室及相关 AI 功能的访问。